Wat GEO is en waarom server‑side tracking de basis is

In dit artikel leggen we uit wat Generative Engine Optimisation (GEO) is, hoe het verschilt van klassiek SEO, waarom de meeste websites nu een blinde vlek hebben, en wat agentschappen en marketingteams concreet daartegen kunnen doen.

Zoeken verandert. Lange tijd betekende online gezien worden vooral één ding: hoog in Google staan. Maar steeds meer mensen krijgen hun antwoorden vandaag de dag rechtstreeks van KI‑tools zoals ChatGPT, Perplexity of Googles AI Overviews, zonder ook maar één link aan te klikken.

Deze verschuiving verandert de spelregels. Wie in digital marketing of data‑analyse werkt, moet begrijpen wat er gebeurt en wat je er concreet aan kunt doen.

Wat GEO eigenlijk betekent

Generative Engine Optimisation, kort GEO, betekent: inhoud zo voorbereiden dat AI‑gestuurde zoeksystemen (zoals ChatGPT, Perplexity of Googles AI Overviews) die kunnen vinden, begrijpen en als bron citeren.

Klassiek SEO helpt je om hoog in de SERPs te scoren. GEO helpt je om in een KI‑gegenereerde antwoordtekst genoemd te worden.

Dat is echt een verschil. Stel dat iemand Perplexity vraagt: “Hoe track ik conversions zonder cookies?”, dan krijgt die persoon een klaargemaakte uitleg, geen lijst van tien links. Dat antwoord komt uit bronnen die het systeem als betrouwbaar en relevant ziet. GEO is het werk dat ervoor zorgt dat jouw content daartoe gerekend wordt.

Waar GEO en SEO verschillen

SEO en GEO delen dezelfde basis: goede inhoud, duidelijke structuur, een betrouwbare website. Toch zijn er duidelijke verschillen.

| SEO | GEO | |

|---|---|---|

| Ziel | Hoch in SERPs ranken | Van AI zitteniert werden |

| Erfolgskennzahl | Klikken, posities, indrukken | Erwähnungen, Zitierungen, Markenpräsenz |

| Was am meisten zählt | Trefwoorden, backlinks, paginasnelheid | Autorität, Kwaliteit, Tiefe |

| Messung | GA4, Search Console | GA4 via SST, Merkbewaking |

Het belangrijkste verschil: bij SEO moet iemand je link nog aanklikken. Bij GEO leest het KI‑systeem je content, vat deze samen en geeft het de gebruiker direct een antwoord. Je merk wordt wellicht vermeld, maar een klik is niet gegarandeerd.

Dat maakt meten lastiger. En juist daar zitten de meeste bedrijven nu in het duister.

Waarom KI‑systemen je website bezoeken

Tools zoals ChatGPT en Perplexity verzinnen hun antwoorden niet uit het niets. Ze zijn getraind op grote hoeveelheden webinhoud, en veel van deze tools crawlen het web ook in real‑time om actuele informatie te vinden.

Als ze je pagina bezoeken, sturen ze een geautomatiseerde bezoeker, een zogenaamde bot. Deze bot leest je paginainhoud, precies zoals een mens, alleen veel sneller en zonder JavaScript uit te voeren. Waarom dat belangrijk is, daar komen we zo nog op terug.

Bekende KI‑crawlers zijn onder meer:

- GPTBot en ChatGPT‑User (OpenAI)

- PerplexityBot (Perplexity)

- ClaudeBot (Anthropic)

- Google‑Extended (voor Googles KI‑producten)

- Meta‑ExternalAgent (Meta)

Elke van deze bots stuurt een herkenbaar signaal, de zogenaamde User‑Agent. Dat is een korte tekstreeks die aangeeft wie je pagina bezoekt. Met de juiste instelling kun je deze bezoeken herkennen en analyseren, en zien welke pagina’s KI‑systemen interessant vinden.

Elk van deze bots zendt een herkenbaar signaal uit, de zogenaamde User-Agent. Dat is een korte string die identificeert wie je site bezoekt. Met de juiste instelling kun je deze bezoeken herkennen en analyseren welke pagina's de interesse van AI-systemen wekken.

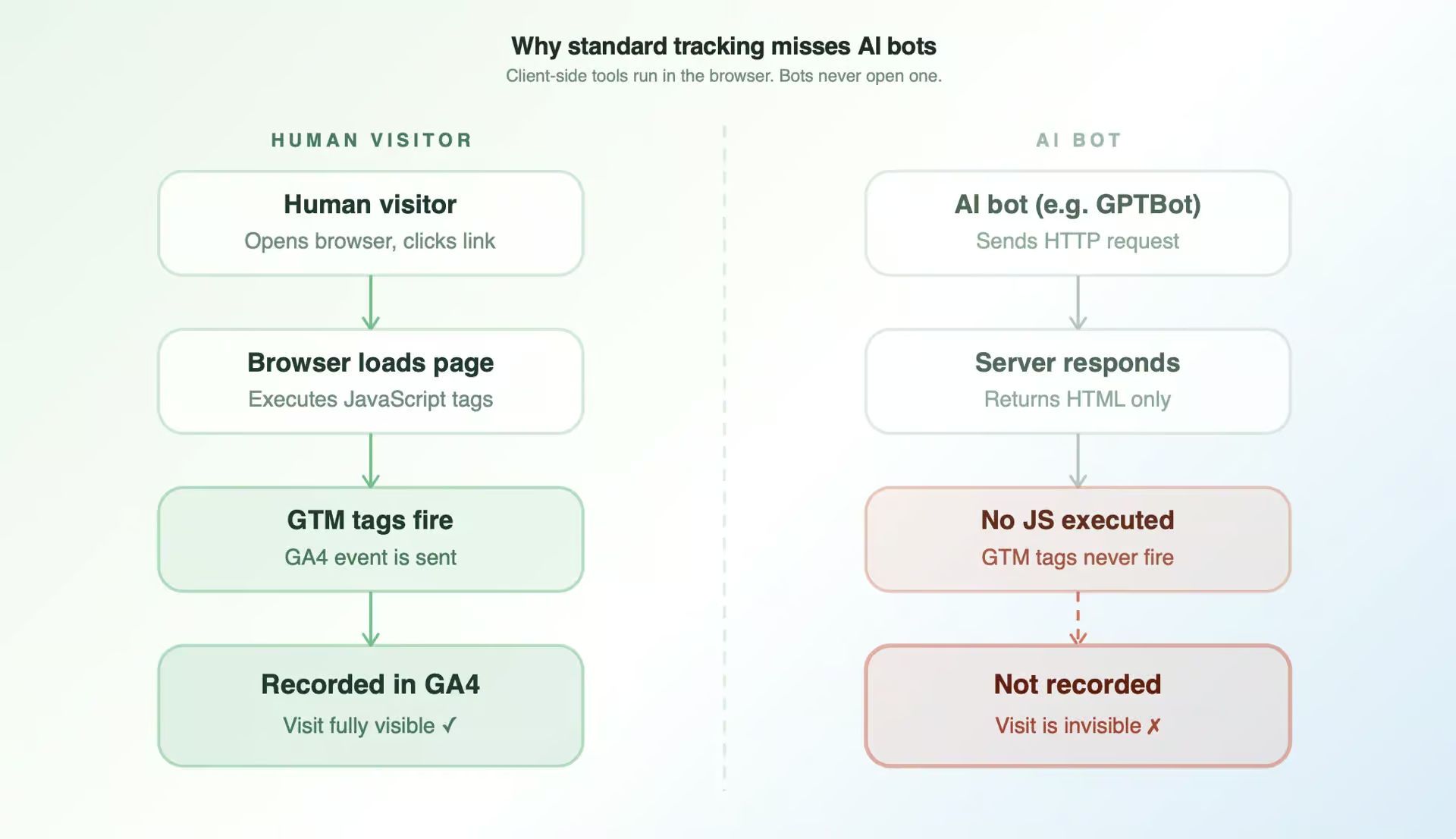

Waarom traditionele tracking hier niets van ziet

Vanaf hier wordt het bijzonder relevant voor iedereen die met data en tracking werkt.

De meeste websites gebruiken client‑side tracking. Dat zijn tools zoals Google Tag Manager of GA4 (Googles huidige analytics‑oplossing), die in de browser van de gebruiker draaien. Dat werkt goed voor menselijke bezoekers. Maar KI‑bots gedragen zich niet als mensen. Ze openen geen browser, ze voeren geen JavaScript uit en ze triggert geen tracking‑tags.

Het resultaat: elke keer dat een KI‑bot je pagina bezoekt, komt er niets in je analytics‑tool te staan. De bezoek bestaat eigenlijk niet.

Dat betekent dat de meeste bedrijven het niet weten:

- Hoe vaak AI-systemen hun inhoud crawlen

- In welke pagina's LLM bots (LLM staat voor Large Language Model, de technologie achter tools zoals ChatGPT) vooral geïnteresseerd zijn

- Of hun inhoud wordt gelezen voordat het ergens wordt geciteerd

Dat is geen klein meetgat. Dat is een blinde vlek precies waar GEO begint.

Waarom schone first‑party‑data het sleutel onderdeel is

Voordat we naar de oplossing gaan, is een kleine stap terug handig.

First‑party‑data zijn gegevens die je rechtstreeks van je eigen website verzamelt, via je eigen setup, zonder tussenkomst van derden. Deze data gelden als de meest betrouwbare bron, omdat niemand anders ze filtert, blokkeert of wijzigt.

Voor GEO zijn schone first‑party‑data juist belangrijk omdat je alleen kunt optimaliseren wat je kunt meten. Als je niet weet welke pagina’s KI‑systemen bezoeken, kun je geen goede beslissingen nemen over welke inhoud je moet verbeteren of uitbreiden.

Het probleem met slechte of gatvolle data is dat het zich vaak niet direct vertoont. Hier zijn een paar praktijkvoorbeelden:

Voorbeeld 1: de pagina die niemand lijkt te kennen

Je hebt een gedetailleerd artikel gepubliceerd over server-side tracking voor e-commerce. Het scoort goed in Google, maar het verschijnt niet in AI-antwoorden. Met client-side tracking zie je alleen menselijke bezoekers. Wat je niet ziet: PerplexityBot crawlt de pagina regelmatig, maar de inhoud is te algemeen om geciteerd te worden. Zonder server-side tracking mis je deze aanwijzing volledig.

Voorbeeld 2: de dode hoek in botverkeer

GPTBot bezoekt je homepage drie keer per week. Je belangrijkste productpagina's worden daarentegen nauwelijks gecrawld. Met server-side tracking zou je dit patroon zien en begrijpen dat je interne links de AI-bots niet leiden naar waar je echte waarde ligt.

Voorbeeld 3: geen signaal, geen optimalisatie

Zonder gegevens over LLM-botbezoeken optimaliseer je op gevoel. Je schrijft artikelen omdat je denkt dat ze relevant zijn, niet omdat je ziet dat AI-systemen actief op zoek zijn naar die onderwerpen.

In alle drie de gevallen is het probleem niet de inhoud zelf. Het is de ontbrekende gegevensbasis.

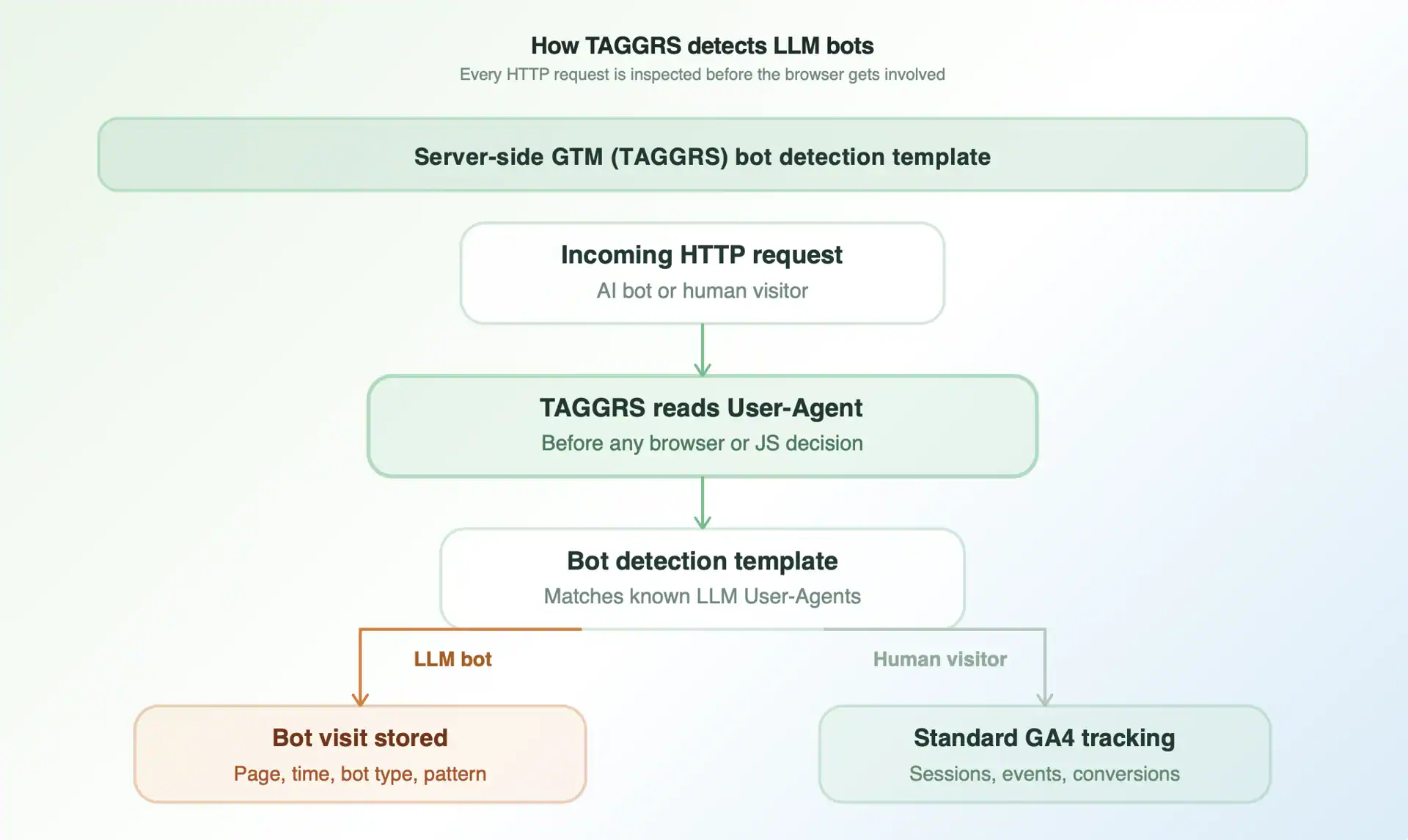

Hoe server-side tracking dit oplost

Server-side Tracking zit een niveau dieper dan client-side tracking. Verzoeken komen bij je server aan voordat een browser of bot beslist wat er wordt uitgevoerd.

Dat betekent: Elke crawl, elk botbezoek, elk HTTP-verzoek laat een spoor achter. Je kunt de User-Agent lezen, de bot identificeren en het bezoek opslaan met volledige context. Bijvoorbeeld met onze TAGGRS Botdetectietool.

Hiervoor hebben we een GTM-sjabloon (Google Tag Manager-sjabloon) gemaakt. Deze controleert de User-Agent op serverniveau, vergelijkt deze met een lijst van bekende LLM-bots en geeft je een duidelijk signaal terug: Was hier zojuist een bekende LLM-bot? Op welke pagina? Wanneer?

Het staat op GitHub:

Met deze gegevens kun je bijvoorbeeld:

- Bekijk welke pagina's het vaakst worden gecrawld door welke AI-systemen

- Patronen herkennen in welke inhoudstypen bijzonder veel botverkeer aantrekken

- Vergelijk welke gecrawlde pagina's daadwerkelijk worden geciteerd in AI-antwoorden en welke niet

- Baseer inhoudsbeslissingen op echte gegevens in plaats van aannames

Waar een goed GEO‑artikel uit bestaat

KI‑systemen herkennen nuttige inhoud verrassend goed. Ze citeren bronnen die:

- Geef een duidelijk, direct antwoord op een specifieke vraag

- gestructureerd zijn (kopjes, opsommingstekens, korte alinea's)

- Neem een duidelijk standpunt in of deel specifieke kennis in plaats van alleen maar samen te vatten wat anderen hebben gezegd

- Een onderwerp diepgaand behandelen en meerdere aspecten behandelen

Vooral dat laatste punt wordt vaak onderschat. Een artikel van 300 woorden dat een onderwerp maar schampt, heeft veel minder kans om geciteerd te worden dan een uitgebreider artikel dat een concept volledig uitlegt, veelvoorkomende fouten benoemt en verwante thema’s verbindt.

Daarom raakt generieke, dunne content nu juist hard aan de mond. Als een KI‑systeem vijf betere uitlegpagina’s over hetzelfde thema vindt, wordt jouw bron vaak overgeslagen.

GEO vervangt SEO niet. De basisregels blijven gelden: een snelle, goed gestructureerde website, duidelijke en crawl‑bare inhoud, sterke interne verlinking tussen aanverwante pagina’s, en vertrouwde backlinks uit relevante bronnen. Maar GEO voegt een nieuwe laag toe. Je optimaliseert niet alleen meer voor een ranking‑algoritme, maar voor een systeem dat je content leest en beslist of die relevant en betrouwbaar genoeg is om in een direct antwoord te worden genoemd.

Wat het voor agencies betekent

Wie in een agentschap werkt of tracking en data voor klanten verantwoordelijk is, ziet: GEO wordt steeds meer een vraag in klantgesprekken. “Doe wij eigenlijk al op als mensen ChatGPT gebruiken?” komt steeds vaker voor. En de meeste agencies hebben daar nog geen antwoord op.

Dat is een opening die je kunt dichten. En de instap is concreter dan veel mensen denken.

Met server-side tracking als basis kun je klanten:

- Zichtbaarheid: Laat zien welke pagina's worden gecrawld door welke AI-systemen, met echte gegevens in plaats van gissingen

- Diagnose: vaststellen waar inhoud wordt gecrawld maar niet geciteerd en wat dat zegt over de kwaliteit van de inhoud

- Strategie: Geef contentaanbevelingen op basis van botgegevens, niet op basis van buikgevoel

- Rapportage: Maak GEO-prestaties meetbaar, zelfs als er nog geen kant-en-klare dashboards voor zijn

Dit is ook zakelijk een sterke positie. GEO is nieuw genoeg dat de meeste concurrenten dit nog niet aanbieden. Wie als eerste aan klanten kan laten zien hoe hun website bij KI‑systemen scoort, heeft een echt voordeel in het gesprek.

Server‑side tracking is daarmee niet alleen de technische basis. Het is wat GEO van speculatie verandert in een discipline die je daadwerkelijk kunt managen. En TAGGRS‑templates maken deze setup sneller en schaalbaarder, zodat niet elke agentschap alles vanaf nul hoeft te bouwen.