Qu'est-ce que la géolocalisation et pourquoi le suivi côté serveur est essentiel ?

Cet article explique ce qu'est l'optimisation générative des moteurs (GEO), en quoi elle diffère du référencement classique, pourquoi la plupart des sites web ont un angle mort à l'heure actuelle et ce que les agences et les équipes marketing peuvent faire pour y remédier.

La recherche évolue. Pendant longtemps, être trouvé en ligne signifiait une chose principale : être bien classé sur Google. Aujourd'hui, de plus en plus de personnes obtiennent leurs réponses directement auprès d'outils d'intelligence artificielle tels que ChatGPT, Perplexity ou les aperçus d'intelligence artificielle de Google, sans même avoir à cliquer sur un seul lien.

Cette évolution change la donne. Toute personne travaillant dans le domaine du marketing numérique ou de l'analyse de données doit comprendre ce qui se passe et ce qu'elle peut faire pour y remédier.

Ce que signifie GEO

L'optimisation générative des moteurs, ou GEO en abrégé, consiste à préparer le contenu de manière à ce que les systèmes de recherche alimentés par l'IA (tels que ChatGPT, Perplexity ou Google AI Overviews) le trouvent, le comprennent et le citent en tant que source.

Le référencement classique vous permet de vous classer dans une liste de liens. Le GEO vous permet d'être mentionné dans une réponse générée par l'IA.

C'est une vraie différence. Si quelqu'un demande à Perplexity "Comment suivre les conversions sans cookies ?", il obtient une réponse toute faite, et non pas dix liens bleus. Cette réponse provient de sources que le système considère comme fiables et pertinentes. GEO est le travail qui garantit que votre contenu en fait partie.

Les différences entre GEO et SEO

SEO et GEO partagent une base commune : un bon contenu, une structure claire, un site web digne de confiance. Mais il existe de réelles différences.

| RÉFÉRENCEMENT | GEO | |

|---|---|---|

| Ziel | Se classer haut dans les SERP | L'IA doit être initiée |

| Taux d'intérêt | Clics, classements, impressions | Prestations, paiements, frais d'enregistrement |

| Ce qui est le plus souvent le cas | Mots-clés, liens retour, vitesse de la page | Autorität, Klarheit, Tiefe |

| Messung | GA4, Search Console | GA4 via SST, surveillance de la marque |

La plus grande différence : Avec le SEO, quelqu'un doit encore cliquer sur votre lien. Avec le GEO, le système d'IA lit votre contenu, le résume et donne à l'utilisateur une réponse directe. Votre marque peut être mentionnée, mais un clic n'est pas garanti.

Cela rend la mesure plus difficile. Et c'est précisément sur ce point que la plupart des entreprises sont actuellement dans le flou.

Pourquoi les systèmes d'IA visitent-ils votre site web ?

Les outils tels que ChatGPT et Perplexity n'inventent pas leurs réponses à partir de rien. Ils sont formés à partir d'énormes quantités de contenu web, et nombre d'entre eux parcourent également le web en temps réel à la recherche d'informations actualisées.

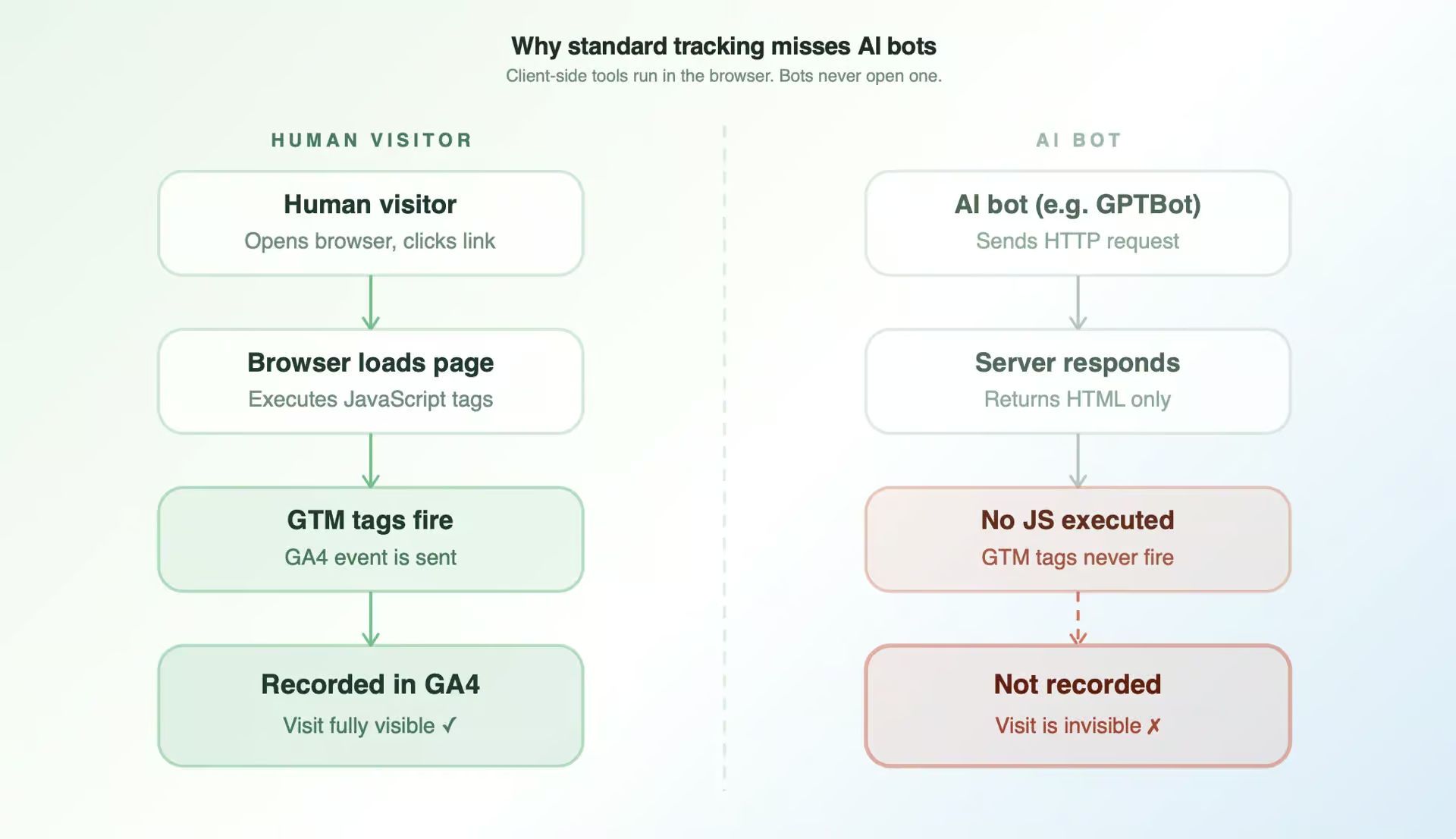

Lorsqu'ils visitent votre site, ils envoient un visiteur automatisé appelé "bot". Ce dernier lit le contenu de votre page comme un humain, mais beaucoup plus rapidement et sans exécuter de JavaScript. Nous verrons plus loin pourquoi c'est si important.

Les robots d'indexation connus sont, par exemple, les suivants :

- GPTBot et ChatGPT-User (OpenAI)

- PerplexityBot (Perplexité)

- ClaudeBot (Anthropique)

- Google-Extended (produits d'intelligence artificielle de Google)

- Meta-ExternalAgent (Meta)

Chacun de ces robots envoie un signal reconnaissable, appelé User-Agent. Il s'agit d'une courte chaîne de caractères qui identifie la personne qui visite votre site. Avec la bonne configuration, vous pouvez reconnaître ces visites et analyser quelles pages suscitent l'intérêt des systèmes d'intelligence artificielle.

Pourquoi le suivi traditionnel ne voit-il rien de tout cela ?

Ceci est particulièrement important pour tous ceux qui travaillent avec les données et le suivi. La plupart des sites web utilisent le suivi côté client. Il s'agit d'outils tels que Google Tag Manager ou GA4 (la solution d'analyse actuelle de Google) qui s'exécutent dans le navigateur de l'utilisateur. Cela fonctionne très bien pour les visiteurs humains. Mais les robots d'intelligence artificielle ne se comportent pas comme des humains. Ils n'ouvrent pas de navigateur, n'exécutent pas de JavaScript et ne déclenchent pas de balises de suivi.

Le résultat ? Chaque fois qu'un robot d'intelligence artificielle visite votre site, rien n'apparaît dans votre outil d'analyse. La visite n'existe tout simplement pas.

Cela signifie que la plupart des entreprises ne le savent pas :

- Fréquence à laquelle les systèmes d'intelligence artificielle explorent leur contenu

- Quelles pages les robots LLM (LLM signifie Large Language Model, la technologie qui se cache derrière des outils tels que ChatGPT) sont particulièrement intéressés ?

- Si leur contenu est lu avant d'être cité quelque part

Il ne s'agit pas d'un petit écart de mesure. Il s'agit d'un angle mort à l'endroit même où commence l'orbite géostationnaire.

Pourquoi les données de première main sont essentielles

Avant de passer à la solution, un petit retour en arrière s'impose.

Les données de première partie sont des données que vous collectez directement à partir de votre propre site web via votre propre configuration, sans passer par des tiers. Elles sont considérées comme la source de données la plus fiable car personne d'autre ne les filtre, ne les bloque ou ne les modifie.

Pour GEO, les données de première main sont cruciales pour une raison simple : vous ne pouvez optimiser que ce que vous pouvez mesurer. Si vous ne savez pas quelles pages les systèmes d'IA visitent, vous ne pouvez pas prendre de décisions éclairées sur le contenu à améliorer ou à développer.

Le problème des données erronées ou incomplètes est qu'elles ne sont souvent pas visibles immédiatement.

Voici quelques exemples de ce que cela donne en pratique :

Exemple 1 : la page que personne ne semble connaître

Vous avez publié un article détaillé sur le suivi côté serveur pour le commerce électronique. Il est bien classé dans Google, mais il n'apparaît dans aucune réponse d'IA. Avec le suivi côté client, vous ne voyez que les visiteurs humains. Ce que vous ne voyez pas : PerplexityBot explore régulièrement la page, mais le contenu est trop générique pour être cité. Sans suivi côté serveur, vous ne voyez pas du tout cet indice.

Exemple 2 : l'angle mort du trafic de robots

GPTBot visite votre page d'accueil trois fois par semaine. En revanche, vos pages de produits les plus importantes sont à peine explorées. Avec le suivi côté serveur, vous verriez ce schéma et comprendriez que vos liens internes ne guident pas les robots d'intelligence artificielle vers les endroits où se trouve votre valeur réelle.

Exemple 3 : pas de signal, pas d'optimisation

En l'absence de données sur les visites de robots LLM, vous optimisez à l'instinct. Vous écrivez des articles parce que vous pensez qu'ils sont pertinents, et non parce que vous voyez que les systèmes d'intelligence artificielle recherchent activement ces sujets.

Dans les trois cas, le problème n'est pas le contenu lui-même. C'est la base de données manquante.

Comment le suivi côté serveur résout le problème

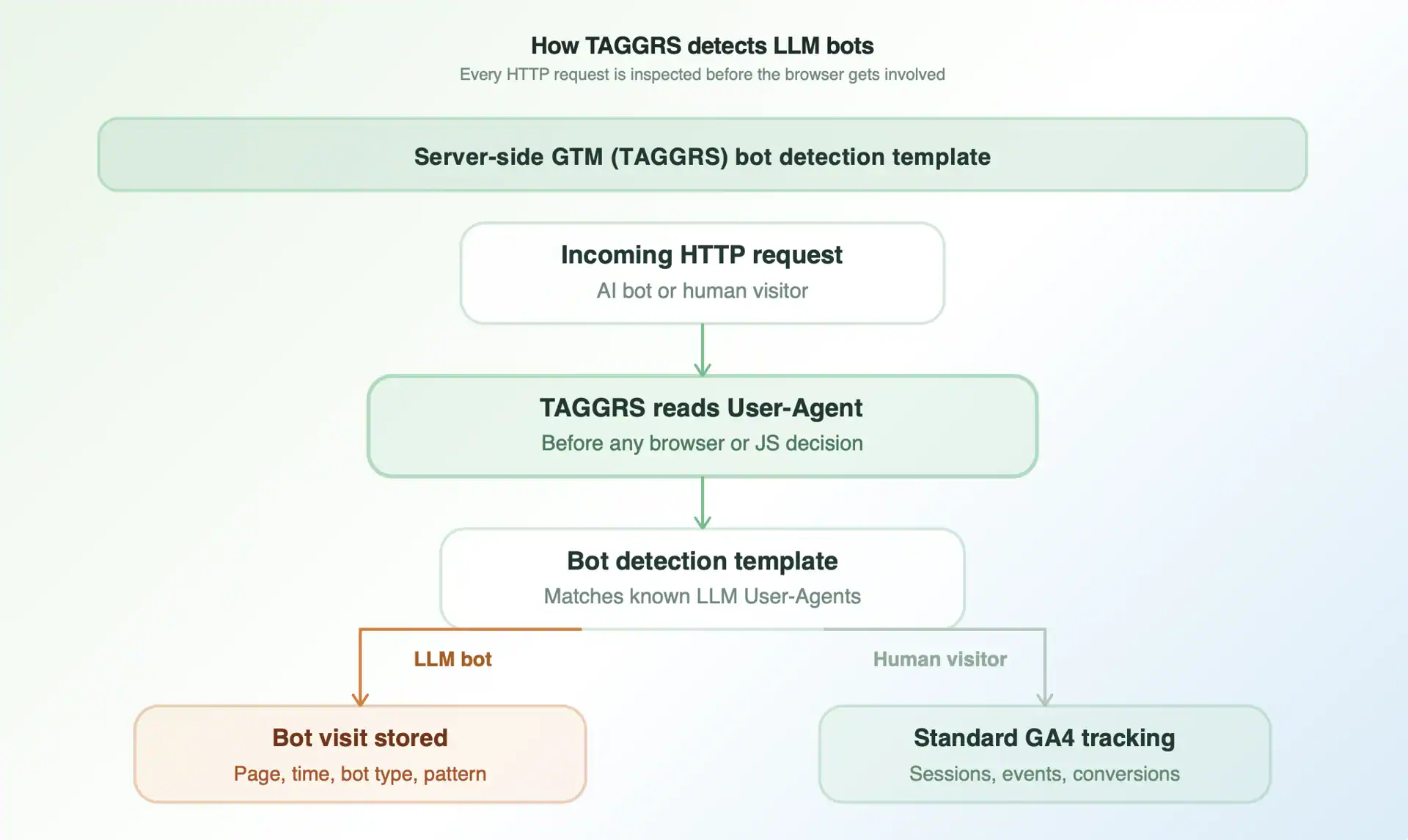

Le suivi côté serveur se situe à un niveau plus profond que le suivi côté client. Les requêtes arrivent sur votre serveur avant qu'un navigateur ou un robot ne décide de ce qu'il doit exécuter.

Cela signifie que : Chaque crawl, chaque visite d'un bot, chaque requête HTTP laisse une trace. Vous pouvez lire l'agent utilisateur, identifier le robot et enregistrer la visite avec un contexte complet. Par exemple, avec notre outil de détection des robots TAGGRS.

Nous avons construit un modèle GTM (modèle Google Tag Manager) pour cela. Il vérifie l'agent utilisateur au niveau du serveur, le compare à une liste de robots LLM connus et vous renvoie un signal clair : Y a-t-il eu un robot LLM connu ici à l'instant ? Sur quelle page ? À quel moment ?

C’est sur GitHub:

Grâce à ces données, vous pouvez, par exemple :

- Découvrez les pages les plus fréquemment explorées par les différents systèmes d'intelligence artificielle.

- Reconnaître les types de contenu qui attirent particulièrement les robots.

- Comparez les pages explorées qui sont effectivement citées dans les réponses de l'IA et celles qui ne le sont pas.

- Baser les décisions relatives au contenu sur des données réelles plutôt que sur des hypothèses

Qu'est-ce qu'un bon contenu GEO ?

Les systèmes d'IA reconnaissent étonnamment bien les contenus utiles. Ils citent des sources qui :

- Donner une réponse claire et directe à une question spécifique

- sont structurés (titres, puces, paragraphes courts)

- Prenez une position claire ou partagez des connaissances spécifiques au lieu de simplement résumer ce que d'autres ont dit.

- Couvrir un sujet en profondeur et aborder de multiples aspects

Ce dernier point est particulièrement sous-estimé. Un article de 300 mots qui ne fait qu'effleurer la surface a beaucoup moins de chances d'être cité qu'un article détaillé qui explique en détail un concept, nomme les erreurs courantes et fait référence à des sujets connexes.

C'est la raison pour laquelle les contenus génériques et peu étoffés sont actuellement en perte de vitesse. Si un système d'intelligence artificielle trouve cinq meilleures explications sur le même sujet, la vôtre disparaît.

Le GEO ne remplace pas le SEO. Les principes de base restent valables : un site web rapide et bien structuré, un contenu clairement explorable, des liens internes solides entre les pages connexes et des liens retour de confiance provenant de sources pertinentes. Mais le référencement ajoute une nouvelle couche. Vous n'optimisez plus seulement pour un algorithme de classement, mais pour un système qui lit votre contenu et décide s'il est suffisamment pertinent et si votre domaine est suffisamment fiable pour être cité dans une réponse directe.

Ce que cela signifie pour les agences

Si vous travaillez dans une agence ou si vous êtes responsable du suivi et des données pour les clients, vous l'aurez remarqué : La géolocalisation devient un véritable sujet de conversation pour les clients. La question " Est-ce que nous apparaissons réellement lorsque les gens utilisent ChatGPT ? " revient de plus en plus souvent. Et la plupart des agences n'ont pas encore de réponse.

C'est un fossé que vous pouvez combler. Et le point d'entrée est plus concret qu'on ne le pense.

Avec le suivi côté serveur comme base, vous pouvez offrir aux clients :

- Visibilité : Montrez quelles pages sont explorées par quels systèmes d'intelligence artificielle, à l'aide de données réelles et non de suppositions.

- Diagnostic : Identifiez les endroits où le contenu est exploré mais non cité, et ce que cela signifie pour la qualité du contenu.

- Stratégie : Faites des recommandations de contenu basées sur les données du robot, et non sur votre intuition.

- Rapports : Rendez les performances des GEO mesurables, même s'il n'existe pas encore de tableaux de bord prêts à l'emploi.

C'est également un argument de vente important. Le GEO est suffisamment nouveau pour que la plupart des concurrents ne le proposent pas encore. Celui qui sera le premier à montrer à ses clients les performances de son site web grâce aux systèmes d'intelligence artificielle aura un réel avantage dans les conversations.

Le suivi côté serveur n'est pas seulement la base technique. C'est ce qui transforme le GEO de la spéculation en une discipline que vous pouvez réellement gérer. Les modèles TAGGRS rendent cette configuration plus rapide et plus évolutive, sans que chaque agence n'ait à tout construire à partir de zéro.