Les publicités ChatGPT sont en ligne. Comment les mesurer ?

Les publicités ChatGPT ont été lancées en février 2026, d'abord pour les utilisateurs américains des niveaux Free et Go. Mais à l'étranger, le programme a atteint un chiffre d'affaires annualisé de 100 millions de dollars en l'espace de six semaines. Plus de 600 annonceurs ont participé au projet pilote. Les principaux groupes d'agences ont engagé des budgets de test. Quel que soit l'indicateur commercial initial, il s'agit d'un succès.

Mais demandez aux annonceurs quels ont été les résultats. Deux dirigeants d'agences qui ont participé aux premiers tests ont confirmé qu'ils n'avaient pas pu démontrer de résultats commerciaux mesurables pour leurs clients. Non pas parce que les publicités ne fonctionnaient pas. Mais parce qu'il n'y avait aucun moyen de le savoir.

C'est ce qui est en jeu ici. Il ne s'agit pas de savoir si ChatGPT peut vendre des publicités. Il est clair qu'il le peut. La question est de savoir s'il peut construire la couche de mesure qui fait que ces publicités valent la peine d'être achetées à grande échelle. Et pour l'instant, la réponse est que personne ne le sait, parce que les données n'existent pas encore.

Plus d'informations sur Search Engine Land : Le projet pilote de ChatGPT laisse les annonceurs sans preuve de retour sur investissement

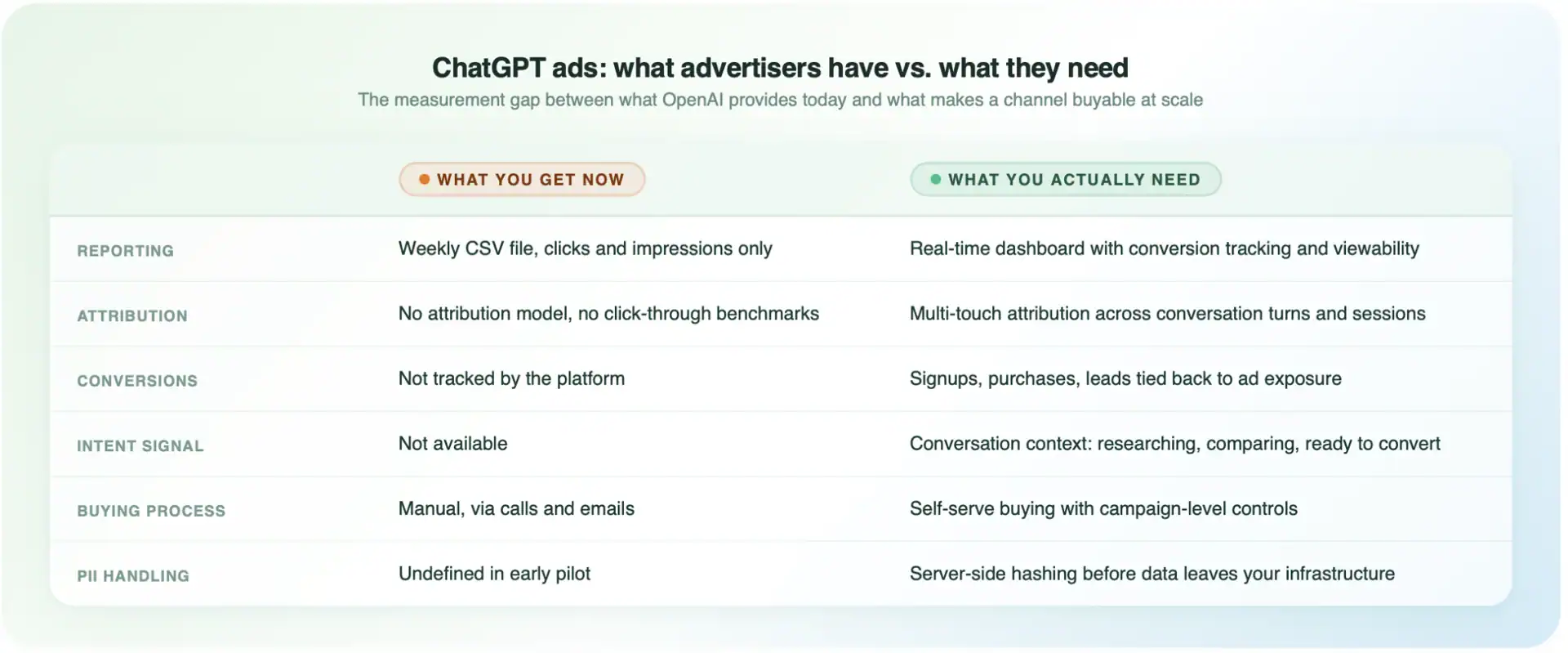

Ce que les annonceurs obtiennent actuellement

Les premiers participants au projet pilote ChatGPT reçoivent un fichier CSV hebdomadaire. Clics. Impressions. C'est à peu près tout. Pas de taux de clics, pas de suivi des conversions, pas de scores de visibilité. Les contrats sont négociés manuellement, par téléphone et par courrier électronique.

One client trial saw a 0.91% CTR against a 6.4% benchmark for traditional Google search in the same sector. Un annonceur d’entreprise distinct n’avait utilisé que 3 % d’un budget de 250 000 $ après plusieurs semaines, en partie à cause d’un problème de rapport qui empêchait la visibilité sur ses propres données.

La pièce manquante n'est pas surprenante si vous réfléchissez au fonctionnement de ce canal. Google ne s'est pas contenté de créer un réseau publicitaire. Il a créé Analytics, Tag Manager, les pipelines BigQuery, les modèles d'attribution, parce que les publicités ne valent la peine d'être achetées que si vous pouvez prouver qu'elles fonctionnent. L'infrastructure de mesure est apparue en même temps que le produit publicitaire et, à bien des égards, avant lui. OpenAI a lancé le produit publicitaire en premier, alors que l'infrastructure de mesure est encore en cours d'élaboration.

Au minimum, toute plateforme publicitaire opérant au sein d'une interface conversationnelle doit s'exposer :

- Impressions : quand la publicité a-t-elle été diffusée, dans quel contexte de conversation ?

- Engagement : l'utilisateur a-t-il interagi avec l'information, y a-t-il donné suite ou l'a-t-il dépassée ?

- Conversions : la session s'est-elle transformée en une inscription, un achat ou une piste ?

- Logique d'attribution : ce qui compte comme succès à travers de multiples conversations

La question la plus intéressante est de savoir ce qui se passera ensuite. OpenAI finira-t-elle par exposer des classifications d'intention basées sur le contexte de la conversation, "recherche", "comparaison", "prêt à convertir" ? Les annonceurs peuvent-ils voir comment une conversation a dérivé autour d'une marque ou d'une offre au cours de plusieurs sessions ? Pouvez-vous segmenter les performances en fonction de ce que l'utilisateur essayait réellement d'accomplir ? Ce type de signal vous rapprocherait de quelque chose comme l'analyse de l'intention conversationnelle : lire des signaux comportementaux réels à partir d'un dialogue naturel plutôt que de déduire l'intention à partir des seuls clics. La question de savoir si l'OpenAI s'oriente dans cette direction reste ouverte.

Pourquoi l'attribution standard n'est pas suffisante

Les conversations sont une unité différente

L'attribution dans le search et le social fonctionne sur un modèle assez stable : quelqu'un clique, il arrive sur une page, quelque chose se passe. Le clic est l'événement. Le chemin de conversion a un début que vous pouvez identifier.

ChatGPT brise cette unité. Ce qui représente traditionnellement sept à dix points de contact dans un cycle d'achat B2B peut être comprimé en un seul fil de conversation asynchrone. Et la "destination" après une interaction publicitaire n'est pas toujours une page web. Parfois, l'utilisateur continue à discuter.

Le problème de la source d'orientation

L'endroit où le trafic ChatGPT apparaît dans vos analyses dépend de la conservation ou non par OpenAI de l'en-tête de référence. Vous pouvez voir chatgpt.com, openai.com, ou direct, selon la façon dont le lien est affiché dans l'interface. Les paramètres UTM sur les URL de clic devraient en principe fonctionner, mais les environnements publicitaires qui s'affichent dans les réponses générées par l'IA ne transmettent pas toujours les paramètres d'URL de manière propre.

Même avec une source correcte, l'attribution au niveau de la campagne est limitée. Quelle création a été à l'origine de la session ? Quelle conversation a suscité la plus forte intention d'achat ? Il est difficile de répondre à ces questions à partir d'un CSV hebdomadaire et presque impossible avec la seule mesure côté client.

Les navigateurs intelligents créent déjà une version du même problème, en modifiant ou en supprimant les données de référence avant l'enregistrement d'une visite. Nous avons expliqué ici comment ce schéma se répercute sur l'attribution. Les publicités ChatGPT ajoutent un problème similaire à un tableau déjà complexe.

Comment mettre en place le suivi avant de tester ce canal ?

La bonne nouvelle, c'est que l'infrastructure de suivi qui vaut la peine d'être mise en place pour les annonces ChatGPT est la même que celle qui améliore les mesures sur tous les canaux que vous utilisez déjà. L'investissement n'est pas à usage unique.

Déplacer les événements vers le serveur

Le suivi côté client dépend du déclenchement de JavaScript dans le navigateur. Les navigateurs bloquent les scripts, expirent les cookies et laissent parfois tomber les données de référence avant qu'une requête ne parvienne à votre plateforme d'analyse. Pour un canal qui vous fournit déjà de maigres données, chaque point de défaillance supplémentaire rend le tableau plus difficile à lire.

Le suivi côté serveur permet de capturer des événements sur votre propre infrastructure avant que les restrictions du navigateur ne s'appliquent. Vous contrôlez ce qui est envoyé à GA4, Meta et Google Ads. Les données qui sont supprimées par une extension ou qui expirent lors d'une session Safari ne constituent pas une lacune de reporting que vous pouvez noter en bas de page. Il s'agit d'un problème structurel dans votre attribution.

Utiliser des cookies côté serveur pour étendre les fenêtres d'attribution

Safari limite à sept jours les cookies créés par JavaScript. D'autres navigateurs évoluent dans la même direction. Un utilisateur qui s'engage aujourd'hui avec une publicité ChatGPT et qui se convertit trois semaines plus tard, après un deuxième point de contact sur un appareil différent, sortira complètement de la fenêtre d'attribution d'un cookie de navigateur.

Les cookies côté serveur contournent les restrictions qui entraînent l'expiration prématurée des cookies définis par le navigateur. Vous pouvez conserver les données d'attribution pendant 30, 60 ou 90 jours. Pour un canal où la fenêtre de considération peut être plus longue que pour une recherche standard, cela est plus important qu'il n'y paraît. Pour en savoir plus sur la façon dont cela fonctionne en pratique : la récupération des cookies expliquée.

Couche UTM, identifiants côté serveur et enrichissement des pages d'atterrissage

Aucune méthode ne permet de combler toutes les lacunes. Une configuration plus fiable combine :

- Paramètres UTM sur les URL des clics publicitaires, pour les cas où la plateforme les conserve.

- Identifiants de session côté serveur qui persistent à travers les appareils et les sessions de navigation

- Enrichissement de la page d'atterrissage à l'entrée, capture de signaux au niveau de l'utilisateur au début de la session afin que l'attribution soit maintenue même lorsque les données de référence arrivent incomplètes.

Si les UTM sont supprimés, l'identifiant de session relie toujours la session à la campagne. Si l'utilisateur change d'appareil en cours de route, les données de session enrichies permettent de reconstituer son parcours.

Hacher les IIP avant qu'elles ne quittent votre serveur

Les signaux de conversion envoyés aux plateformes publicitaires pour l'appariement des clients impliquent généralement des adresses électroniques ou des numéros de téléphone. Le fait d'effectuer ce hachage dans le navigateur signifie que la logique est visible dans la source de la page et que les données passent par un environnement que vous ne contrôlez pas entièrement.

Sur le serveur, vous contrôlez le hachage avant que les données ne quittent votre infrastructure. La plateforme reçoit ce dont elle a besoin pour la mise en correspondance. Rien d'autre ne voyage. C'est plus propre pour la conformité au GDPR, et cela ne casse pas si l'exécution JavaScript se comporte de manière inattendue dans un nouvel environnement publicitaire.

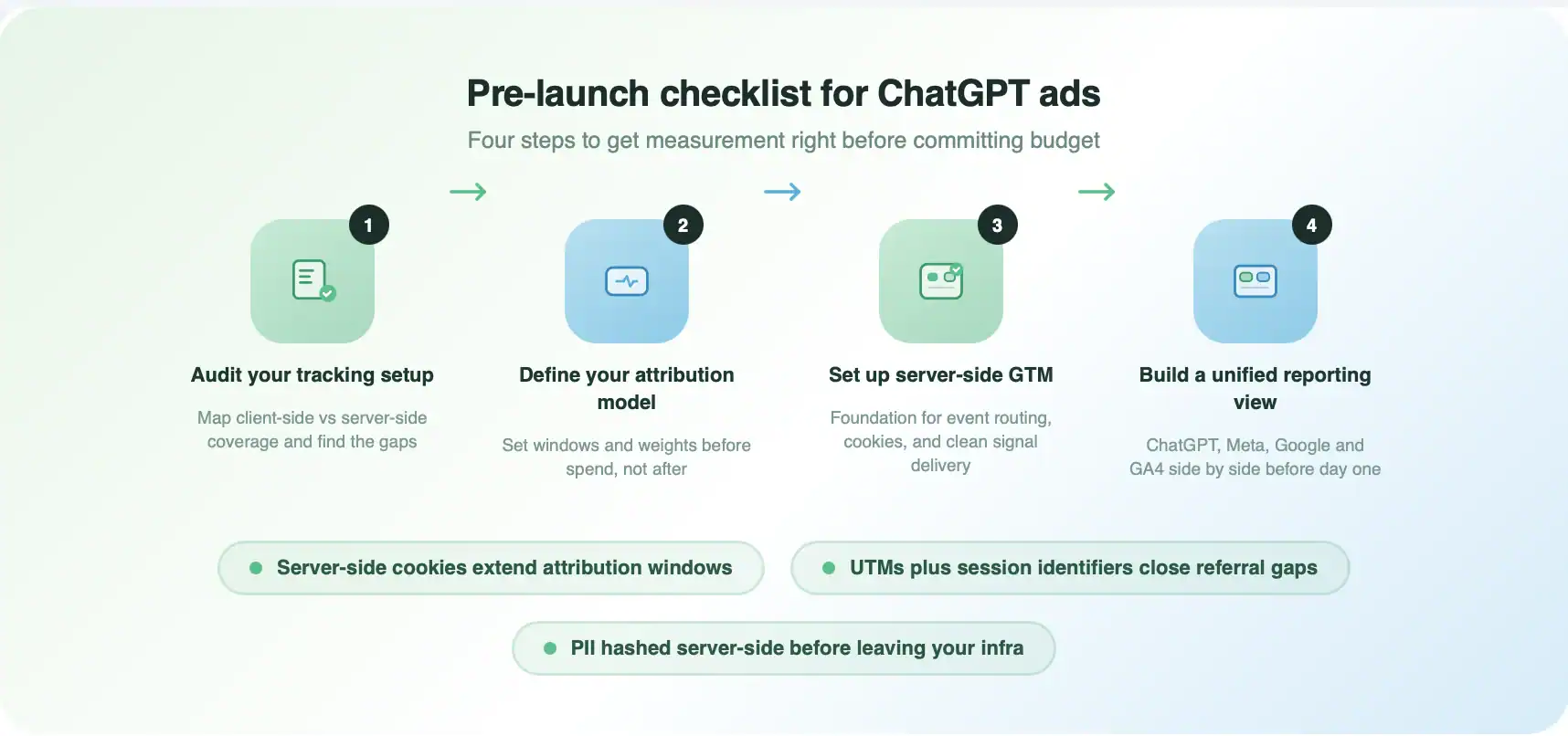

Liste de contrôle pour le pré-lancement

Avant d'engager un budget, ces quatre étapes valent la peine d'être franchies.

1. Auditer votre système de suivi actuel

Cartographiez ce qui s'exécute côté client et côté serveur. Si la majeure partie de votre suivi des conversions dépend encore de l'exécution de GTM dans le navigateur et des cookies définis par JavaScript, cette configuration sera moins performante sur un canal avec des chemins d'attribution multi-sessions et multi-appareils. La mise en évidence de ce point fait généralement apparaître quelques lacunes qui n'étaient pas évidentes de l'intérieur.

2. Définissez votre modèle d'attribution avant la première campagne

Le ChatGPT n'entre pas dans le cadre du dernier clic ni même dans celui de la plupart des modèles d'attribution fondés sur des données et construits autour de parcours de clics clairs. Avant le lancement, décidez comment vous allez pondérer les points de contact conversationnels et quelle fenêtre d'attribution s'applique à ce canal. Faire cela avant de dépenser signifie que vous pouvez comparer ChatGPT à Meta et Google sur des bases cohérentes. Le faire rétroactivement signifie reconstruire l'analyse avec le budget déjà dépensé.

3. Configurer le GTM côté serveur

Un conteneur GTM côté serveur est la base du routage des événements, de la gestion des cookies côté serveur et de la livraison de signaux propres. Il améliore également l'attribution à travers vos canaux existants, de sorte que la configuration est payante, que les publicités ChatGPT fassent ou non partie de votre mix média.

4. Créer une vue unifiée des rapports

Un nouveau canal fragmente les rapports si vous ne le prévoyez pas. Obtenez un tableau de bord qui met ChatGPT, Meta, Google Ads et GA4 côte à côte avant que la première campagne ne soit lancée. La comparaison du coût par conversion entre les canaux vous permet de savoir si les dépenses liées à ChatGPT génèrent des retours réels ou si elles ne font qu'ajouter du bruit à votre modèle d'attribution.

La place de TAGGRS

L'infrastructure décrite ici, la collecte d'événements côté serveur, les fenêtres d'attribution étendues, l'enrichissement des pages d'atterrissage, la gestion des IIP côté serveur, est ce qu'un environnement GTM côté serveur bien configuré vous offre. TAGGRS fournit un hébergement GTM côté serveur avec routage des événements, gestion des cookies, transformation des données et intégration des plateformes publicitaires, sans que vous ayez à gérer vous-même l'infrastructure sous-jacente.

Pour les équipes qui envisagent des canaux tels que les annonces ChatGPT, la configuration gère l'attribution qui ne s'effondre pas lorsque les parcours des utilisateurs ne suivent pas des chemins de clics clairs. La même infrastructure améliore la qualité du signal pour Meta, Google Ads et GA4, ce qui permet de résoudre bien plus que le problème de mesure d'un seul canal.

Ce que nous attendons toujours de savoir

La mesure des publicités ChatGPT va changer. OpenAI a mis au point un gestionnaire d'annonces dédié, ainsi que des outils d'achat en libre-service prévus pour les mois à venir. L'ère du CSV hebdomadaire ne durera pas éternellement.

Ce qui est moins clair, c'est la profondeur des données. Les rapports de base sur les clics et les conversions constituent le plancher. La question de savoir si les annonceurs obtiendront un jour un contexte intentionnel à partir des conversations, des signaux sur l'évolution de la pensée d'un utilisateur au fil des sessions, ou des données structurées sur les événements qu'ils pourront intégrer dans leurs propres pipelines, reste ouverte. L'industrie l'a demandé. L'OpenAI ne s'est pas engagée à le faire.

En attendant cette clarté, les équipes qui tireront le meilleur parti de ce canal sont celles qui ne comptent pas sur la plateforme pour effectuer leurs mesures à leur place. L'infrastructure que vous construisez de votre côté est la partie que vous contrôlez.

Le projet pilote est actuellement en cours aux États-Unis et s'étend au Canada, à l'Australie et à la Nouvelle-Zélande. Le déploiement en Europe est prévu pour le quatrième trimestre 2026.

Cet article sera mis à jour au fur et à mesure du développement des outils de mesure et du modèle de partage des données de l'OpenAI.