Los Anuncios ChatGPT están en directo. ¿Cómo medirlos?

ChatGPT-Anzeigen wurden im Februar 2026 eingeführt, zunächst für US-Nutzer auf den Stufen Free und Go. Aber in Übersee erzielte das Programm innerhalb von sechs Wochen einen Jahresumsatz von 100 Millionen Dollar. Über 600 Werbetreibende beteiligten sich an dem Pilotprojekt. Große Agenturgruppen haben Testbudgets zugesagt. Nach den ersten kommerziellen Maßstäben sieht dies wie ein Erfolg aus.

Aber fragen Sie die Werbetreibenden , was die Ergebnisse waren. Zwei Führungskräfte von Agenturen, die an den ersten Tests teilgenommen haben, bestätigten, dass sie keine messbaren Geschäftsergebnisse für ihre Kunden vorweisen konnten. Nicht, weil die Anzeigen nicht funktionierten. Weil es keine Möglichkeit gab, das festzustellen.

Das ist die eigentliche Geschichte hier. Nicht, ob ChatGPT Anzeigen verkaufen kann. Das kann es eindeutig. Die Frage ist, ob es die Messungsebene aufbauen kann, die diese Anzeigen in großem Umfang kaufenswert macht. Und im Moment lautet die Antwort, dass das niemand weiß, weil die Daten noch nicht vorhanden sind.

Lesen Sie mehr auf Search Engine Land: ChatGPT-Anzeigen-Pilotprojekt lässt Werbetreibende ohne Nachweis des ROI zurück

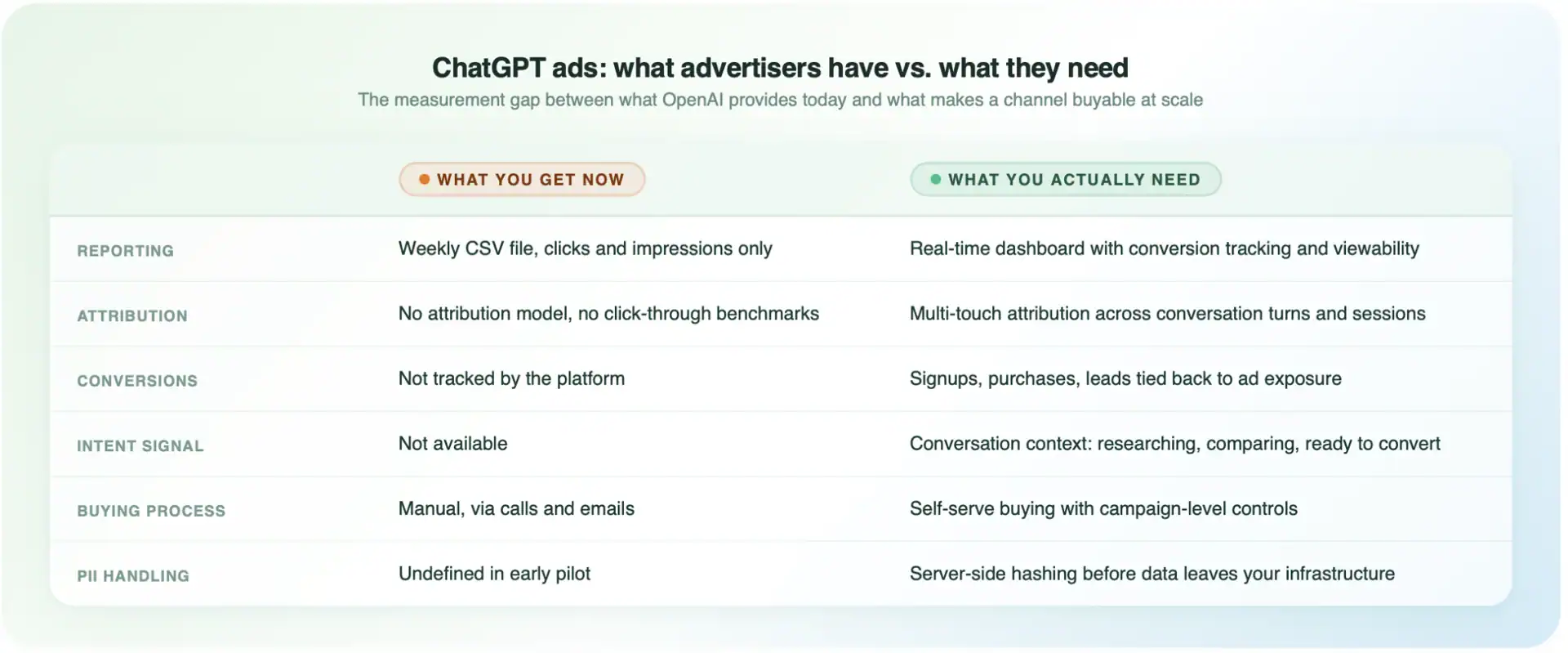

Was Werbetreibende jetzt tatsächlich bekommen

Frühe Teilnehmer am ChatGPT-Anzeigenpilotprogramm erhalten wöchentlich eine CSV-Datei. Klicks. Eindrücke. Das war's auch schon. Keine Click-Through-Rate-Benchmarks, kein Conversion-Tracking, keine Viewability-Scores. Die Deals werden manuell ausgehandelt, durch Anrufe und E-Mails.

In einem Test erreichte ein Kunde eine Klickrate von 0,91 %, verglichen mit einem Benchmark von 6,4 % für die traditionelle Google-Suche im selben Sektor. Ein separater Unternehmenswerbetreibender hatte nach mehreren Wochen nur 3 % eines Budgets von 250 000 $ verwendet, teilweise aufgrund eines Reporting-Fehlers, der die Sichtbarkeit ihrer eigenen Daten blockierte.

Das fehlende Stück ist nicht überraschend, wenn Sie sich überlegen, wie dieser Kanal funktioniert. Google hat nicht nur ein Werbenetzwerk aufgebaut. Sie haben Analytics, Tag Manager, BigQuery-Pipelines und Attributionsmodelle entwickelt, denn Anzeigen lohnen sich nur, wenn Sie beweisen können, dass sie funktionieren. Die Messinfrastruktur entstand parallel zum Anzeigenprodukt und in vielerlei Hinsicht sogar davor. OpenAI hat das Anzeigenprodukt zuerst auf den Markt gebracht, während die Messinfrastruktur noch in der Entwicklung begriffen ist.

Zumindest muss jede Werbeplattform, die innerhalb einer konversationellen Schnittstelle arbeitet, diese offenlegen:

- Impressionen: wann wurde die Anzeige gezeigt, in welchem Gesprächskontext

- Engagement: Hat der Benutzer mit der Seite interagiert, sie weiterverfolgt oder sie übersprungen?

- Konversionen: Wurde die Sitzung schließlich in eine Anmeldung, einen Kauf oder einen Lead umgewandelt?

- Zurechnungslogik: Was zählt als Erfolg über mehrere Gesprächsrunden hinweg?

Die interessantere Frage ist, was danach kommt. Wird OpenAI irgendwann Absichtsklassifizierungen auf der Grundlage des Konversationskontextes aufdecken, also "recherchieren", "vergleichen", "bereit zur Konversion"? Können Werbetreibende sehen, wie sich ein Gespräch über mehrere Sitzungen hinweg um eine Marke oder ein Angebot gedreht hat? Können Sie die Leistung danach segmentieren, was der Nutzer tatsächlich erreichen wollte? Diese Art von Signalen würde Sie näher an so etwas wie Conversational Intent Analytics heranführen: das Lesen von echten Verhaltenssignalen aus natürlichen Dialogen, anstatt die Absicht allein aus Klicks abzuleiten. Ob sich OpenAI in diese Richtung bewegt, ist noch offen.

Warum die Standardzuschreibung nicht ausreicht

Konversationen sind eine andere Einheit

Die Zuteilung in der Suche und in sozialen Netzwerken läuft nach einem ziemlich stabilen Modell ab: Jemand klickt, er landet auf einer Seite, etwas passiert. Der Klick ist das Ereignis. Der Konversionspfad hat einen Anfang, den Sie identifizieren können.

ChatGPT durchbricht diese Einheit. Was traditionell sieben bis zehn Berührungspunkte in einem B2B-Kaufzyklus sind, kann auf einen einzigen asynchronen Gesprächsfaden komprimiert werden. Und das "Ziel" nach einer Anzeigeninteraktion ist nicht immer eine Webseite. Manchmal plaudert der Benutzer einfach weiter.

Das Problem der Überweisungsquellen

Wo der ChatGPT-Verkehr in Ihren Analysen auftaucht, hängt davon ab, ob OpenAI den Referrer-Header beibehält. Sie können chatgpt.com, openai.com oder direkt sehen, je nachdem, wie der Link innerhalb der Schnittstelle angezeigt wird. UTM-Parameter auf Klick-URLs sollten im Prinzip funktionieren, aber Anzeigenumgebungen, die innerhalb von KI-generierten Antworten gerendert werden, geben URL-Parameter nicht immer sauber weiter.

Selbst mit einer korrekten Quelle ist die Zuordnung auf Kampagnenebene begrenzt. Welches Werbemittel hat die Sitzung ausgelöst? Welche Unterhaltung hatte die höchste Kaufabsicht? Diese Fragen lassen sich mit einer wöchentlichen CSV-Datei nur schwer beantworten und sind mit clientseitigen Messungen allein fast unmöglich.

KI-Browser schaffen bereits eine Version desselben Problems, indem sie Empfehlungsdaten ändern oder entfernen, bevor ein Besuch registriert wird. Wir haben hier beschrieben, wie sich dieses Muster auf die Zurechnung auswirkt. ChatGPT-Anzeigen fügen ein ähnliches Problem zu einem bereits komplexen Bild hinzu.

Wie Sie das Tracking einrichten, bevor Sie diesen Kanal testen

Die gute Nachricht ist, dass die Tracking-Infrastruktur, die es wert ist, für ChatGPT-Anzeigen aufgebaut zu werden, dieselbe Infrastruktur ist, die die Messung in allen Kanälen verbessert, die Sie bereits betreiben. Die Investition ist nicht für den einmaligen Gebrauch bestimmt.

Verschieben Sie Ereignisse auf die Serverseite

Client-seitiges Tracking hängt vom Abfeuern von JavaScript im Browser ab. Browser blockieren Skripte, Cookies laufen ab und manchmal werden Verweisdaten gelöscht, bevor eine Anfrage an Ihre Analyseplattform weitergeleitet wird. Bei einem Kanal, der Ihnen ohnehin schon wenig Daten liefert, wird das Bild mit jedem zusätzlichen Fehlerpunkt unübersichtlicher.

Server-side-Tracking erfasst Ereignisse auf Ihrer eigenen Infrastruktur, bevor Browser-Einschränkungen greifen. Sie kontrollieren, welche Daten an GA4, Meta und Google Ads gesendet werden. Daten, die durch eine Erweiterung blockiert oder in einer Safari-Sitzung ablaufen, sind keine Berichtslücke, die man einfach vermerken kann – sie stellen ein strukturelles Problem in Ihrer Attribution dar.

Verwenden Sie Server-seitige Cookies, um die Attributionsfenster zu erweitern

Safari begrenzt von JavaScript gesetzte Cookies auf sieben Tage. Andere Browser bewegen sich in dieselbe Richtung. Ein Nutzer, der heute eine ChatGPT-Anzeige aufruft und drei Wochen später, nach einem zweiten Touchpoint auf einem anderen Gerät, konvertiert, fällt völlig aus dem Zuordnungsfenster eines Browser-Cookies heraus.

Serverseitige Cookies umgehen die Beschränkungen, die dazu führen, dass die vom Browser gesetzten Cookies vorzeitig ablaufen. Sie können die Attributionsdaten für 30, 60 oder 90 Tage speichern. Für einen Kanal, bei dem das Betrachtungsfenster länger sein kann als bei der Standardsuche, ist das wichtiger als es klingt. Mehr dazu, wie das in der Praxis funktioniert: Cookie-Wiederherstellung erklärt.

Layer UTMs, serverseitige Identifikatoren und Landing Page Enrichment

Keine einzelne Methode kann alle Lücken schließen. Eine zuverlässigere Einrichtung kombiniert:

- UTM-Parameter auf Anzeigenklick-URLs, für die Fälle, in denen die Plattform sie beibehält

- Serverseitige Sitzungskennungen, die über Geräte und Browser-Sitzungen hinweg bestehen bleiben

- Anreicherung der Landing Page beim Einstieg, Erfassung von Signalen auf Benutzerebene zu Beginn der Sitzung, so dass die Zuordnung auch dann erhalten bleibt, wenn die Empfehlungsdaten unvollständig eintreffen

Wenn UTMs entfernt werden, verbindet die Sitzungskennung die Sitzung immer noch mit der Kampagne. Wenn der Benutzer mitten in der Reise das Gerät wechselt, können die angereicherten Sitzungsdaten immer noch den Pfad rekonstruieren.

Verschlüsseln Sie PII, bevor sie Ihren Server verlassen

Conversion-Signale, die für den Kundenabgleich an Werbeplattformen gesendet werden, beinhalten normalerweise E-Mail-Adressen oder Telefonnummern. Das Hashing im Browser bedeutet, dass die Logik im Seitenquelltext sichtbar ist und die Daten eine Umgebung durchlaufen, die Sie nicht vollständig kontrollieren können.

Auf dem Server kontrollieren Sie das Hashing, bevor die Daten Ihre Infrastruktur verlassen. Die Plattform erhält das, was sie für den Abgleich benötigt. Nichts anderes wird transportiert. Das ist sauberer für die Einhaltung der Datenschutzbestimmungen und wird nicht unterbrochen, wenn sich die JavaScript-Ausführung in einer neuen Anzeigenumgebung unerwartet verhält.

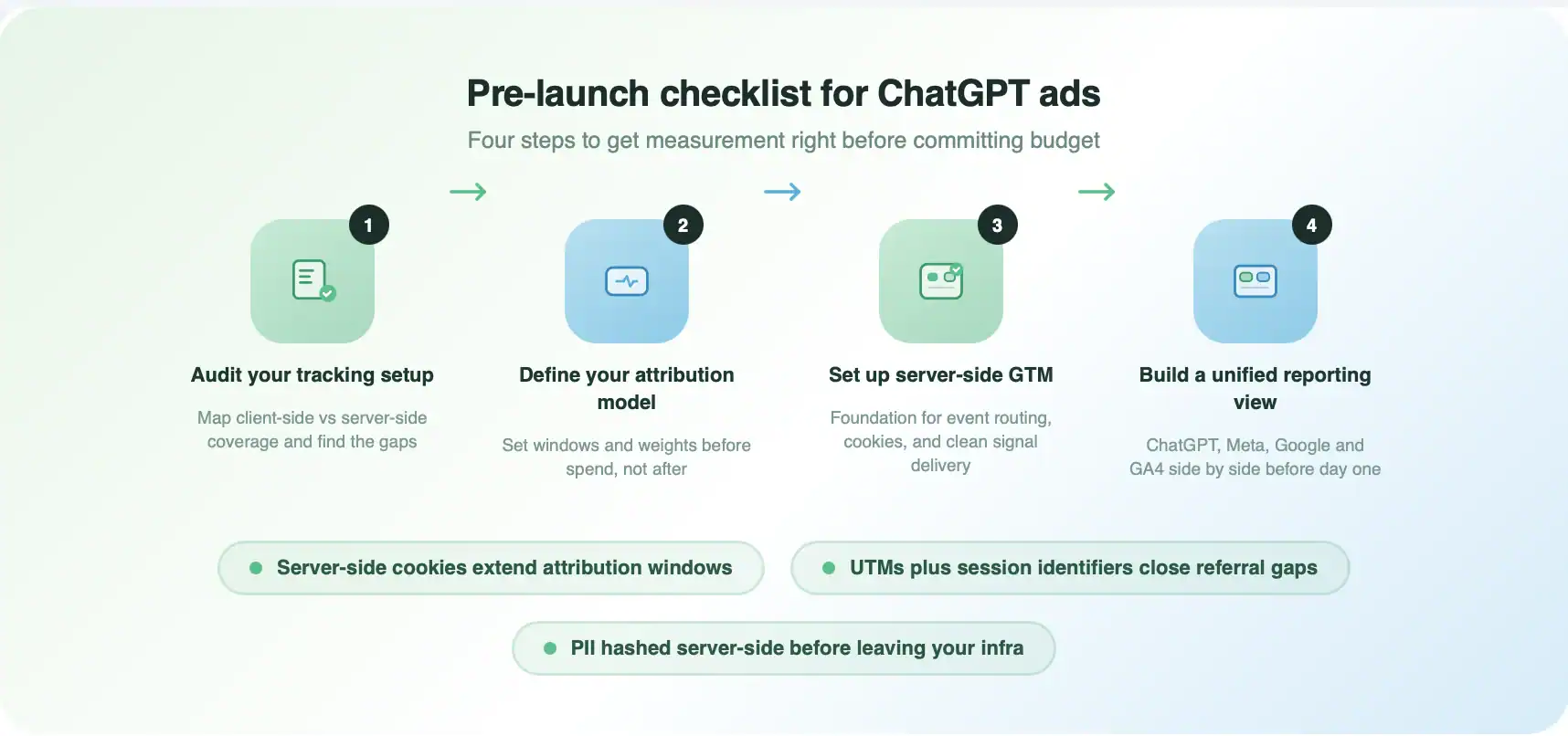

Pre-Launch Checkliste

Bevor Sie sich auf ein Budget festlegen, sollten Sie diese vier Schritte durcharbeiten.

1. Prüfen Sie Ihre derzeitige Tracking-Einrichtung

Stellen Sie fest, was auf der Client-Seite und was auf der Server-Seite läuft. Wenn der größte Teil Ihres Conversion-Trackings immer noch von GTM im Browser und von JavaScript-Cookies abhängt, wird dieses Setup bei einem Kanal mit Multi-Session- und Multi-Device-Attributionspfaden unterdurchschnittlich abschneiden. Wenn Sie dies herausfinden, werden in der Regel einige Lücken sichtbar, die von innen heraus nicht offensichtlich waren.

2. Definieren Sie Ihr Attributionsmodell vor der ersten Kampagne

ChatGPT passt nicht in das Last-Click-Modell und auch nicht in die meisten datengesteuerten Attributionsmodelle, die auf sauberen Klickpfaden basieren. Legen Sie vor dem Start fest, wie Sie die Conversational Touchpoints gewichten und welches Attributionsfenster für diesen Kanal gilt. Wenn Sie dies tun, bevor Sie Geld ausgeben, können Sie ChatGPT mit Meta und Google zu einheitlichen Bedingungen vergleichen. Im Nachhinein bedeutet dies, dass Sie die Analyse neu erstellen müssen, da das Budget bereits aufgebraucht ist.

3. Server-seitiges GTM einrichten

Ein serverseitiger GTM-Container ist die Grundlage für das Event-Routing, die serverseitige Cookie-Verwaltung und die saubere Signalauslieferung. Er verbessert auch die Attribution über Ihre bestehenden Kanäle, so dass sich die Einrichtung auszahlt, unabhängig davon, ob ChatGPT-Anzeigen Teil Ihres Medienmixes werden oder nicht.

4. Erstellen Sie eine einheitliche Berichtsansicht

Ein neuer Kanal fragmentiert die Berichterstattung, wenn Sie sie nicht einplanen. Besorgen Sie sich ein Dashboard, das ChatGPT, Meta, Google Ads und GA4 nebeneinander stellt, bevor die erste Kampagne läuft. Der Vergleich der Kosten pro Conversion über die verschiedenen Kanäle hinweg zeigt Ihnen, ob die ChatGPT-Ausgaben einen echten Gewinn bringen oder nur ein Rauschen in Ihrem Attributionsmodell verursachen.

Wo TAGGRS passt

Die hier beschriebene Infrastruktur, serverseitige Ereigniserfassung, erweiterte Attributionsfenster, Landing Page Enrichment, serverseitige PII-Verarbeitung, ist das, was Ihnen eine gut konfigurierte serverseitige GTM-Umgebung bietet. TAGGRS bietet serverseitiges GTM-Hosting mit integriertem Event-Routing, Cookie-Management, Datentransformationen und Werbeplattform-Integrationen, ohne dass Sie die zugrunde liegende Infrastruktur selbst verwalten müssen.

Für Teams, die über Kanäle wie ChatGPT-Anzeigen nachdenken, sorgt das Setup für eine Attribution, die nicht zusammenbricht, wenn die User Journeys nicht sauberen Klickpfaden folgen. Dieselbe Infrastruktur verbessert die Signalqualität für Meta, Google Ads und GA4, so dass sie mehr als nur das Messproblem eines einzelnen Kanals löst.

Worauf wir noch warten, um es herauszufinden

Das Messbild für ChatGPT-Anzeigen wird sich ändern. OpenAI hat einen eigenen Ads Manager in der Entwicklung, und für die kommenden Monate sind Tools zum Selbsteinkauf geplant. Die Ära der wöchentlichen CSV wird nicht ewig andauern.

Was weniger klar ist, ist, wie tief die Daten gehen werden. Grundlegende Berichte über Klicks und Konversionen sind die Basis. Ob Werbetreibende irgendwann einen Kontext auf der Ebene der Absichten aus Gesprächen, Signale über die Entwicklung des Denkens eines Nutzers über mehrere Sitzungen hinweg oder strukturierte Ereignisdaten erhalten werden, die sie in ihre eigenen Pipelines einfließen lassen können, ist noch eine offene Frage. Die Branche hat danach gefragt. OpenAI hat sich noch nicht dazu verpflichtet.

Bis diese Klarheit herrscht, werden die Teams am meisten von diesem Kanal profitieren, die sich nicht darauf verlassen, dass die Plattform die Messungen für sie übernimmt. Die Infrastruktur, die Sie auf Ihrer Seite aufbauen, ist der Teil, den Sie kontrollieren.

Das Pilotprojekt ist derzeit in den USA live und wird auf Kanada, Australien und Neuseeland ausgeweitet. Die Einführung in Europa wird voraussichtlich im 4. Quartal 2026 erfolgen.

Dieser Artikel wird aktualisiert, sobald sich die Messinstrumente und das Datenaustauschmodell von OpenAI weiterentwickeln.