Test A/B côté serveur : meilleurs tests, meilleure mesure

Le test A/B côté serveur assigne et rend les variantes d'expérience sur le serveur avant le chargement de la page dans le navigateur. Cette méthode améliore la fiabilité des tests en éliminant à la source les problèmes courants côté client :

- bloqueurs de pubs supprimant les scripts

- exécution retardée modifiant la vue du visiteur

- le flicker effect, où la page originale apparaît avant la variante.

Ces problèmes faussent les résultats. Un test tardif ou inconstant mélange les soucis de livraison aux résultats, rendant les données moins fiables pour les marketeurs et agences.

Pour les agences, c'est crucial. L'objectif n'est pas seulement de lancer un test, mais d'exécuter des expériences fiables, respectueuses de la vie privée et solides pour justifier des budgets clients et canaux. Une configuration fragile donne des rapports convaincants sur des données incomplètes.

Côté performance aussi : les tests client-side usent de JavaScript extra et masquage de page, nuisant à la vitesse perçue et Core Web Vitals. Plongez dans le lien serveur-side, scintillement et vitesse : Comment le tracking côté serveur affecte-t-il la vitesse de page.

Le test A/B côté serveur va au-delà d'expérimentations propres : c'est un virage vers une mesure privacy-first et meilleure qualité de données. Le maîtriser aide les agences à bâtir des programmes d'expérimentation résistants à l'examen.

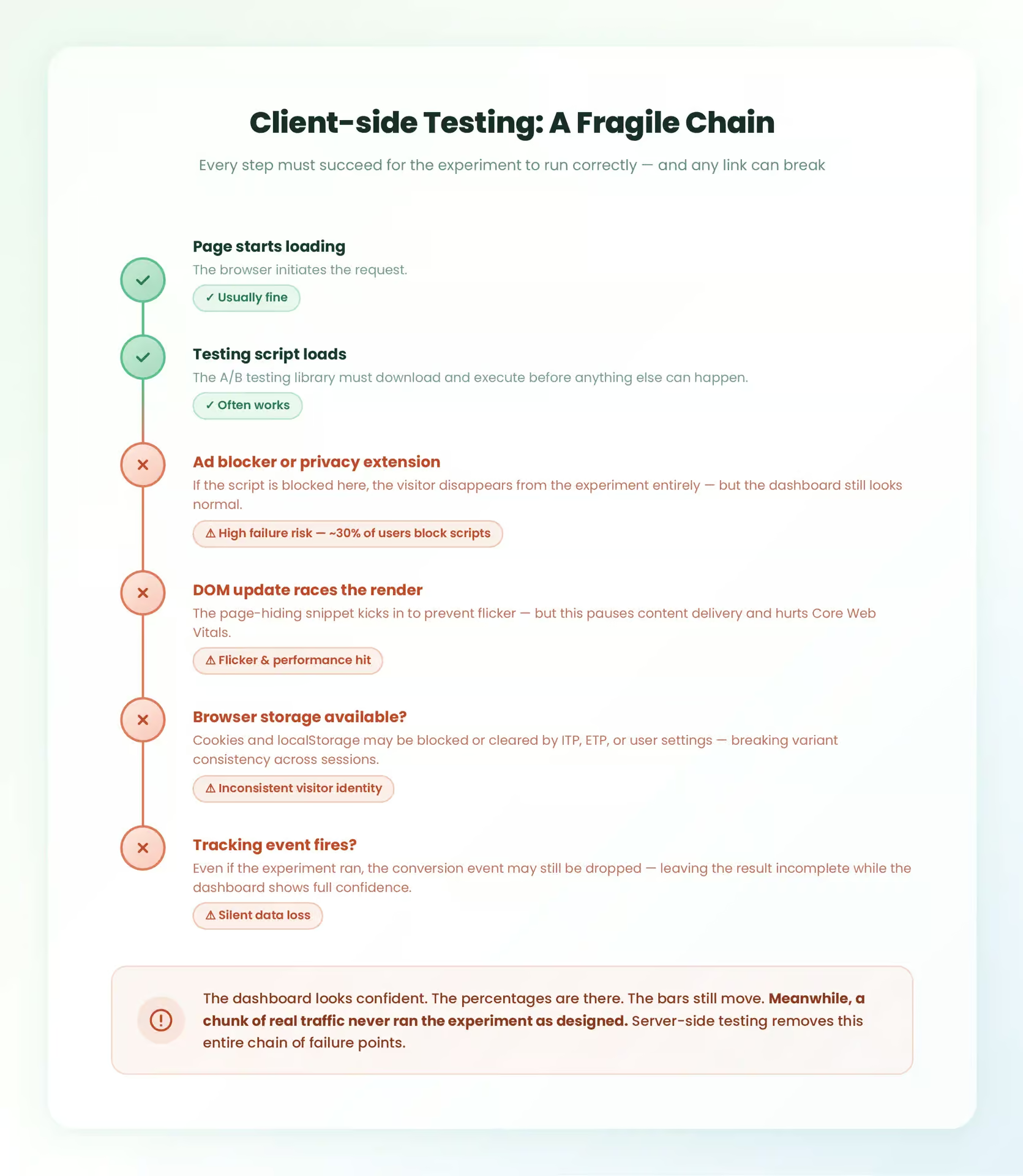

Les tests client-side marchent jusqu'à ce que l'environnement résiste

Les tests A/B côté client sont flexibles, familiers et relativement faciles à lancer. Des outils comme VWO et Optimizely ont donné aux équipes des éditeurs visuels, une configuration rapide et la possibilité de tester des changements au niveau de la page sans support technique lourd. Pour les pages d'atterrissage, les tests de messages et les expériences de mise en page simples, cela reste important.

Les ennuis commencent quand on les traite comme en labo contrôlé. La réalité : non. Ils se passent dans le navigateur, l'un des endroits les plus chaotiques.

Un test client-side survit à une chaîne d'événements. Page charge, script test charge, navigateur l'autorise, bloqueur/privacy l'ignore, stockage disponible, DOM mis à jour, tracking fire. Si tout va, propre. Si un maillon lâche, rapports trop confiants.

Le flicker est l'exemple visible. Visiteur atterrit, voit l'original une fraction de seconde, variante snap. Mineur en théorie, mais altère l'instant mesuré : clics rapides, hésitations, abandons car page "cassée". Le test mesure aussi les effets de livraison.

Performance liée : outils masquent page pour anti-scintillement, protégeant transition mais pausant contenu, retardant Core Web Vitals – rarement voulu pour tester hero image ou bouton.

Les bloqueurs pubs font pire invisiblement. Script supprimé = visite disparue ou déformée. Dashboard normal, pourcentages/ confiances là, mais trafic n'a pas vu le test prévu.

Le scope aussi sous-estimé jusqu'à tests business. Client-side bon pour changements post-chargement. Moins pour pricing, ranking, reco, checkout – préoccupations serveur, où browser arrive trop tard.

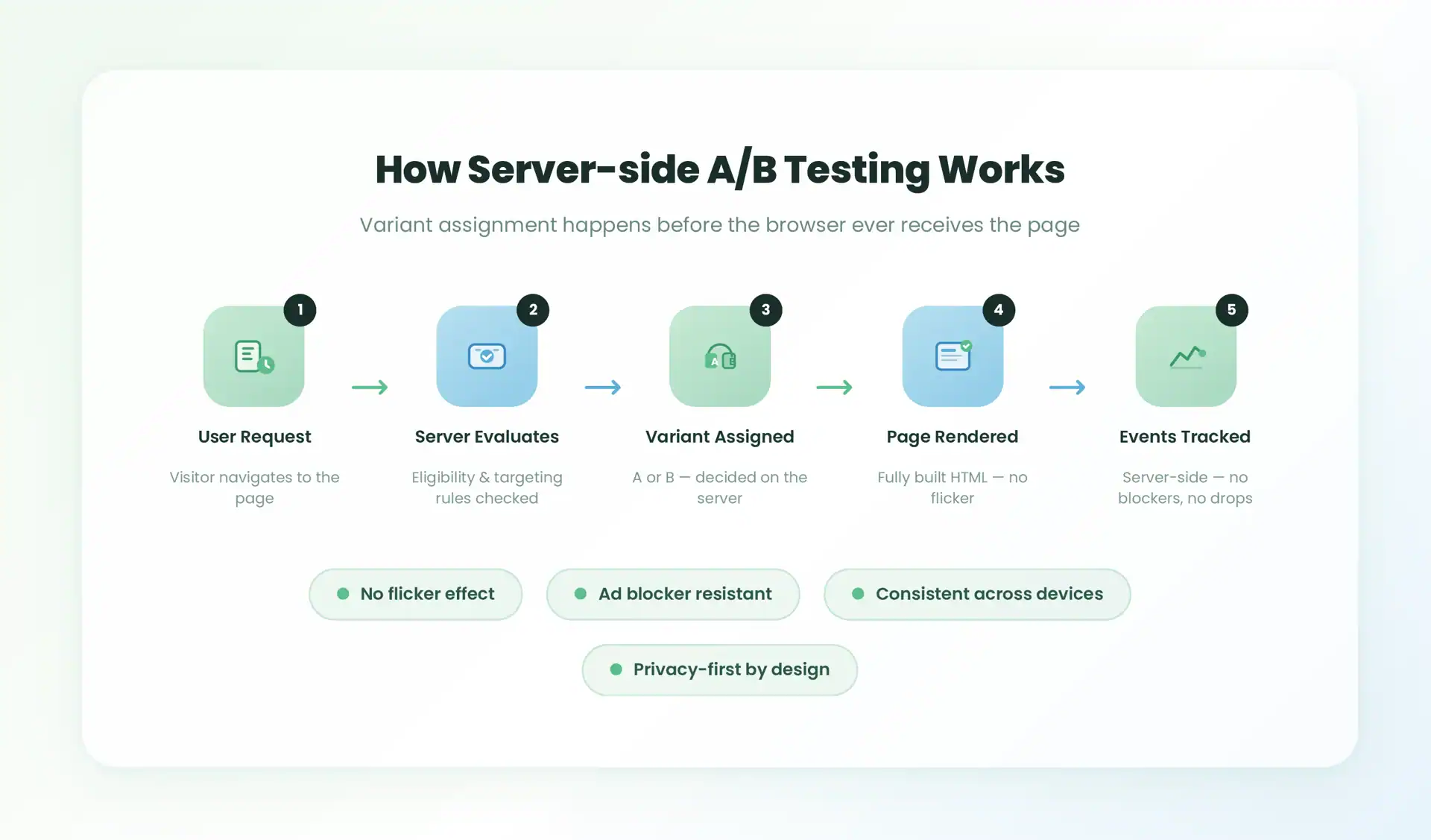

Comment fonctionne le test A/B côté serveur

Flux simple :

- Requête utilisateur atteint serveur

- Serveur évalue éligibilité, assigne variante

- Réponse générée sur cette variante

- Utilisateur reçoit version rendue sans modif client-side

- Événements/outcomes trackés (idéalement serveur-side)

Décision pré-chargement = indépendant de scripts browser, stockage, timing.

Comment le test A/B côté serveur change la donne

Il rapproche décision de l'app. Requête arrive, éligibilité évaluée, variante assignée, réponse built avant browser. Page arrive : expérience déjà décidée.

Ça change plus qu'on pense.

Scintillement quasi disparu : pas de swap visuel post-load, variante dans HTML. Bloqueurs moins impact : pas de script client à survivre. Assignation loggée en système contrôlé, pas event browser incertain.

Virage stratégique : logique serveur = tests au-delà surface. Ranking produit, règles éligibilité, pricing, onboarding, reco, checkout partie expérimentale. Différent de changer couleur CTA.

Performance améliorée (précisément) : pas auto-rapide partout, mauvaise archi ralentit. Mais évite overhead browser client-side : pas snippet masquage, rewrite DOM last-second, dépendance extra. Expérience souvent meilleure.

Test A/B client-side vs serveur-side

| Client-side | Server-side | |

| Propriété & implémentation | Autonomie marketeurs courte terme. Lancements faciles éditeurs visuels. | Propriété ingénierie upfront. Plus contrôle, coût setup plus haut. |

| Performance & Core Web Vitals | Introduit scintillement, delays masquage, JS extra. | Évite overhead browser. Variantes rendues pré-utilisateur. |

| Précision données | Résultats biaisés par scripts bloqués, delays, swaps post-load. Dashboard complet, trafic manquant. | Assignation serveur : bloqueurs/delays/DOM n'affectent pas variante/relevé. |

| Flexibilité | Fort pour changements surface : copy, layout, images. | Logique profonde : règles éligibilité, pricing, ranking, reco. |

Pourquoi c'est une décision d'architecture mesure

Équipes voient A/B comme CRO. Compréhensible, mais serveur élève les enjeux : tactique page → décision architecture mesure.

Shifts clairs :

Scope : Client-side UI-centric. Server-side touche pricing, ranking search, reco, onboarding, décisions façonnant expérience.

Contexte : Au-delà tests page isolés, journeys larges liant attribution, retargeting, qualité signal canaux. Détails : https://taggrs.io/retargeting-strategies-signal-loss/

Opérationnel : Experiments browser = blockers, scripts delays, ID inconstants. Server-side = logique en systèmes contrôlés.

Réglementaire : Multi-régions/dispositifs/privacy stricte, server-side aligne GDPR : collecte/processing délibérée.

C'est également la raison pour laquelle les agences devraient s'en préoccuper. Les agences sont rarement jugées uniquement sur le fait qu'une variante suscite des clics sur une page. Elles sont jugées sur la fiabilité du résultat pour l'ensemble des clients, des canaux, des systèmes de reporting et des décisions budgétaires. C'est pourquoi il est préférable de considérer les tests A/B côté serveur comme une infrastructure, et non comme une simple optimisation.

Quand le côté client a encore du sens

Les tests A/B côté client ne sont pas obsolètes.

Il reste utile pour :

- Expériences rapides au niveau des pages

- Campagnes temporaires

- Modifications de la conception du poids léger

Les tests côté client sont pratiques lorsqu'un faible niveau d'incertitude est acceptable. Les tests côté serveur deviennent nécessaires lorsque l'incertitude devient coûteuse.

Ce changement peut se produire pour plusieurs raisons. L'expérience touche peut-être à la logique des recettes. L'organisation opère peut-être à une échelle suffisamment grande pour qu'une petite erreur de mesure ait un réel impact financier. Il se peut que le même test doive rester cohérent quel que soit l'appareil ou l'état de connexion. Ou peut-être que l'entreprise est tout simplement fatiguée de prétendre que la diffusion et la mesure des navigateurs sont suffisamment stables pour prendre des décisions qui ont un poids réel.

5 scénarios idéaux pour les tests A/B côté serveur

Les tests A/B côté serveur prennent tout leur sens lorsque l'expérience va au-delà des modifications cosmétiques de la page et commence à toucher à la logique qui est plus difficile à respecter dans le navigateur.

- Logique complexe de personnalisation et d'éligibilité qui doit être évaluée avant le rendu de la page

- Environnements à haut trafic ou à haut risque où même de petites erreurs de mesure peuvent s'avérer coûteuses

- Valider les changements apportés à un site web, une application ou un produit lorsque les performances, la stabilité et l'exactitude des données sont toutes importantes en même temps.

- Réaliser des expériences sans ajouter de scripts de masquage de page, de scintillement ou de surcharge côté client susceptible de nuire à la cohérence de l'interface utilisateur.

- Les équipes qui ont dépassé GA4 pour l'analyse des expériences et qui ont besoin d'un ensemble d'outils d'expérimentation appropriés tels que Optimizely Feature Experimentation, Amplitude Experiment, Statsig, VWO, ou LaunchDarkly.

Les bases de la mise en œuvre

Une configuration côté serveur commence généralement par une plateforme qui prend en charge les SDK côté serveur ou l'évaluation des fonctionnalités dans le backend. Optimizely Feature Experimentation, Amplitude Experiment, Statsig, VWO et LaunchDarkly apparaissent tous dans cette conversation pour une bonne raison. Chacun d'entre eux offre aux équipes un mélange légèrement différent de gestion d'expériences, de ciblage et d'outils statistiques, et le bon choix dépend fortement de la pile qui l'entoure.

À partir de là, l'évaluation des variantes doit trouver sa place dans l'application. Dans certaines piles, elle se trouve dans les services dorsaux. Dans d'autres, elle se trouve dans l'intergiciel, la logique de bord ou la couche de rendu. Ce qui importe le plus, c'est le timing. L'affectation doit avoir lieu avant que la réponse ne soit assemblée, et non après le début du chargement de la page dans le navigateur.

Les mesures méritent autant d'attention que la logique d'affectation. C'est la partie que les équipes sous-estiment souvent. L'utilité d'une expérience dépend du flux d'événements qui la mesure, et ce flux d'événements peut encore se dégrader s'il dépend de scripts de navigateur confrontés à des bloqueurs, à des restrictions de stockage ou à des demandes abandonnées. La mise en place d'un traitement adéquat ne représente que la moitié du travail.

C'est également la raison pour laquelle le GA4 n'est généralement pas le meilleur outil pour l'analyse d'expériences sérieuses. GA4 est excellent pour de nombreux cas d'utilisation analytique, mais l'expérimentation contrôlée exerce une pression différente sur les données. L'échantillonnage, les limites de session et la logique d'attribution peuvent tous rendre l'interprétation plus difficile qu'elle ne devrait l'être. Les plateformes d'expérimentation dédiées sont conçues pour ce type d'analyse, ce qui n'est pas le cas des outils d'analyse généraux.

La place de TAGGRS

TAGGRS est important lorsqu'une équipe souhaite que l'expérimentation côté serveur aboutisse à des rapports auxquels elle peut réellement se fier, et pas seulement à une livraison de variantes plus propres.

Les tests A/B côté serveur résolvent une partie du problème. Il décide de la variante avant que la page n'atteigne le navigateur, ce qui élimine une grande partie du bruit habituel côté client. C'est important, mais ce n'est que la moitié de la chaîne de mesure. L'autre moitié est ce qui se passe après que l'utilisateur a vu la page : quels événements sont capturés, comment ils sont enrichis, où ils sont transmis et s'ils arrivent intacts lorsque les navigateurs, les bloqueurs ou les scripts fragiles s'y opposent.

C'est cette lacune que TAGGRS aide à combler. TAGGRS exécute l'infrastructure Google Tag Manager côté serveur, de sorte que les événements d'expérience, les événements de conversion et les signaux d'attribution peuvent être traités sur le serveur au lieu de dépendre fortement du navigateur. Concrètement, cela signifie qu'il n'y a pas de requêtes bloquées, pas de signaux perdus et une meilleure chance que les plateformes comme Google Ads, Meta et GA4 reçoivent des données qui correspondent à ce qui s'est réellement passé dans l'expérience.

Sans cette couche, une entreprise peut améliorer la configuration de l'expérience tout en laissant la configuration du rapport dans la même position de faiblesse qu'auparavant. L'attribution des variantes devient plus fiable, mais les données de conversion peuvent toujours être incomplètes. Les bloqueurs de publicité peuvent toujours interférer. Les restrictions imposées par les navigateurs peuvent toujours supprimer les identifiants ou empêcher les requêtes d'aboutir. L'attribution peut encore s'éloigner de la réalité. L'expérience semble donc plus propre sur le papier, mais les mesures qui la sous-tendent restent incohérentes.

Avec TAGGRS en place, l'installation devient plus cohérente. L'expérience est décidée côté serveur, et le pipeline de mesure est également rapproché du serveur. Cela permet aux équipes de mieux contrôler la manière dont les données sont collectées, transformées et envoyées. Il est également plus facile de standardiser le traitement des événements entre les expériences, les plateformes publicitaires et les outils d'analyse, au lieu de laisser chaque session de navigation déterminer ce qui survit.

Cela est d'autant plus important lorsque les expériences influencent des décisions réelles. Si une agence utilise les résultats d'un test pour défendre une recommandation budgétaire, si une équipe produit modifie la logique de tarification ou si les dirigeants comparent des variantes qui affectent les revenus, une mesure partielle constitue une grave faiblesse. Dans ces cas-là, TAGGRS n'est pas un simple complément de suivi. Il fait partie de l'infrastructure qui aide à rendre les résultats de l'expérience utilisables en premier lieu.

Aucun système d'analyse n'est parfait et TAGGRS n'élimine pas magiquement toutes les sources de bruit. Mais il rend le système beaucoup plus difficile à briser. C'est là tout l'intérêt. Les tests côté serveur vous permettent de réaliser une expérience plus propre. TAGGRS vous aide à vous assurer que les données issues de cette expérience sont également plus propres.

Conclusion

Les tests A/B côté serveur sont d'autant plus utiles que l'expérimentation va au-delà des ajustements de l'interface utilisateur et commence à influencer la logique du produit, l'attribution et les décisions en matière de revenus. Les tests côté client ont toujours un rôle à jouer. Mais pour les équipes qui se soucient de la confiance dans les décisions, les tests côté serveur constituent une base plus solide.

Combiné au TAGGRS, il crée un système où l'expérimentation et la mesure sont plus fiables.

C'est là le véritable avantage : il ne s'agit pas seulement de meilleurs tests, mais aussi de meilleures décisions.

FAQ : Tests A/B côté serveur

Qu'est-ce que le test A/B côté serveur ?

Les tests A/B côté serveur attribuent des variantes d'expérience avant le chargement de la page, ce qui garantit une diffusion cohérente et des données plus fiables.

Les tests A/B côté serveur sont-ils meilleurs que côté client ?

Cela dépend. Le côté serveur est meilleur pour la précision, la performance et la logique complexe. Le côté client est plus rapide pour les tests simples.

Les tests A/B côté serveur améliorent-ils la précision des données ?

Oui. Il réduit l'impact des bloqueurs de publicité, des retards de script et des événements de suivi abandonnés.