Pruebas A/B en el servidor: mejores experimentos, mejor medición

Las pruebas A/B del lado del servidor son un método en el que las variaciones del experimento se asignan y se representan en el servidor antes de que la página se cargue en el navegador. Esta forma de probar mejora la fiabilidad de los experimentos porque elimina en origen algunos de los problemas más comunes del lado del cliente:

- los bloqueadores de anuncios eliminan los scripts

- ejecución retardada que cambia lo que ve el visitante

- el efecto de parpadeo, en el que la página original aparece antes de que la variante la alcance.

Estos problemas distorsionan los resultados de los experimentos. Una prueba que se carga tarde o se comporta de forma incoherente ya está mezclando problemas de entrega en el resultado, lo que hace más difícil que los vendedores y las agencias confíen en lo que realmente significa el resultado.

Especialmente para las agencias, eso es importante. El trabajo rara vez consiste simplemente en lanzar un experimento. El trabajo consiste en realizar experimentos que sean fiables, respetuosos con la privacidad y lo suficientemente sólidos como para respaldar las decisiones presupuestarias entre clientes y canales. Cuando la propia configuración del experimento es frágil, los informes pueden parecer convincentes mientras que los datos subyacentes son incompletos.

También hay una cuestión de rendimiento. Las pruebas del lado del cliente a menudo se basan en JavaScript adicional y técnicas de ocultación de páginas que pueden perjudicar la velocidad percibida y Core Web Vitals. Puedes profundizar en la relación entre las configuraciones del lado del servidor, el parpadeo y la velocidad de la página merece la pena conocerla con más detalle, consulta Cómo afecta el seguimiento del lado del servidor a la velocidad de la página.

Las pruebas A/B del lado del servidor no se limitan a una experimentación más limpia: forman parte de un cambio más amplio hacia una medición que da prioridad a la privacidad y una mejor calidad de los datos. Entenderlo bien ayuda a las agencias a crear programas de experimentación que realmente resistan el escrutinio.

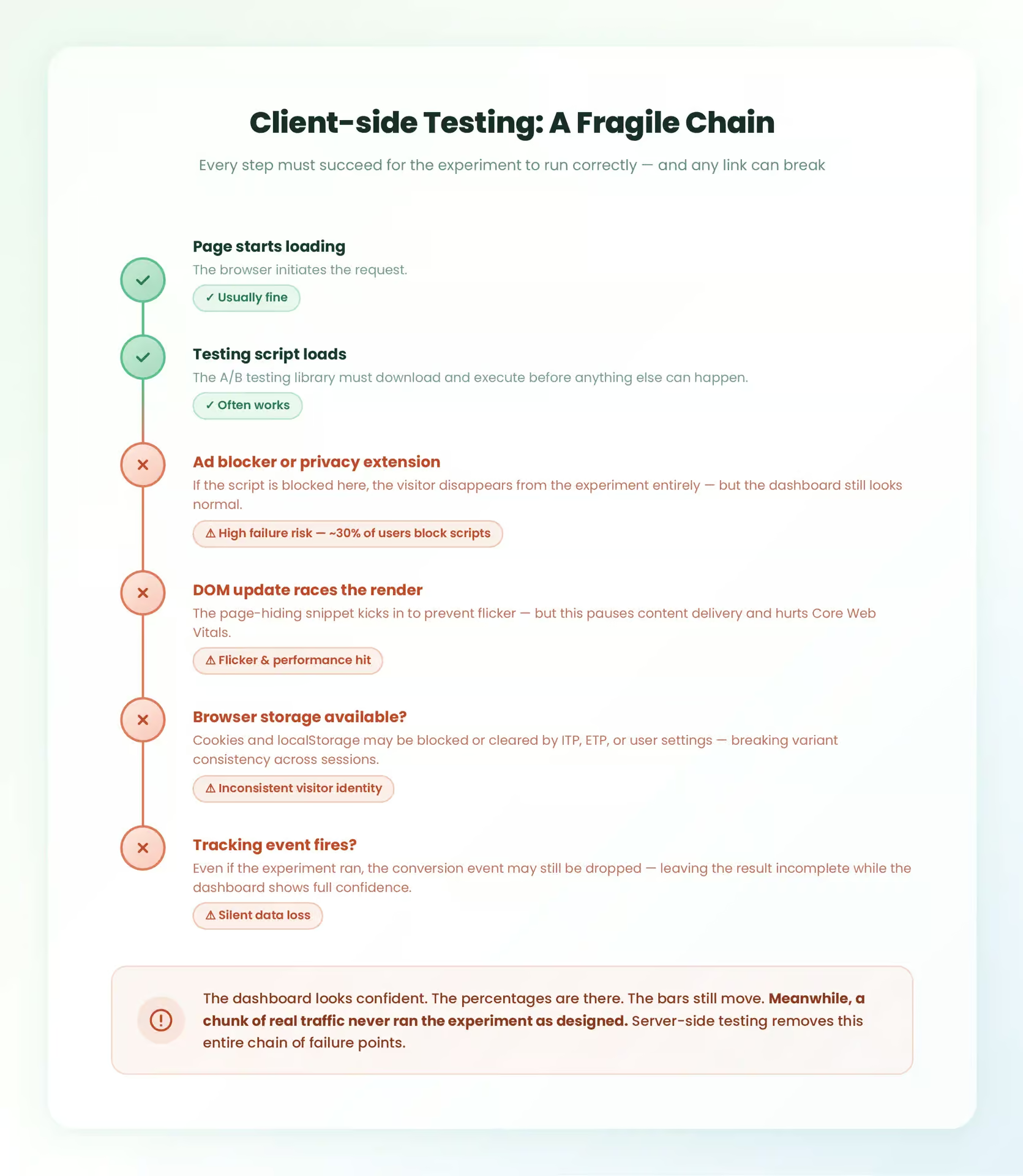

Las pruebas en el lado del cliente funcionan hasta que el entorno empieza a empujar hacia atrás

Las pruebas A/B del lado del cliente son flexibles, familiares y relativamente fáciles de poner en marcha. Herramientas como VWO y Optimizely proporcionaron a los equipos editores visuales, una configuración rápida y la posibilidad de probar cambios a nivel de página sin un gran apoyo de ingeniería. Para las páginas de destino, las pruebas de mensajería y los experimentos sencillos de diseño, eso sigue siendo importante.

El problema empieza cuando esos experimentos se tratan como si ocurrieran en un laboratorio controlado. La realidad es que no es así. Ocurren en el navegador, que es uno de los lugares más desordenados de la pila de la que depender.

Una prueba A/B del lado del cliente tiene que sobrevivir a una cadena de acontecimientos bastante larga. La página se carga, el script de prueba se carga, el navegador permite que se ejecute, cualquier bloqueador o extensión de privacidad lo deja en paz, el almacenamiento necesario permanece disponible, el DOM se actualiza correctamente, y la llamada de seguimiento sigue disparándose después. Cuando todo eso funciona, el experimento puede parecer limpio. Cuando incluso un paso falla, el informe tiende a parecer más seguro de lo que debería.

Flicker es el ejemplo más visible. Un visitante entra en la página, ve la versión original durante una fracción de segundo y, a continuación, observa cómo la variante encaja en su lugar. Puede parecer poca cosa, pero cambia la experiencia exactamente en el momento que la prueba debe medir. Algunas personas hacen clic más rápido de lo esperado. Algunas dudan. Algunas se van porque la página parece brevemente rota. En ese momento, el experimento ya no mide sólo el cambio de diseño. También mide los efectos secundarios del método de entrega.

El rendimiento está ligado al mismo problema. Muchas herramientas de prueba intentan reducir el parpadeo ocultando partes de la página hasta que la variante esté lista. Esa solución puede proteger la transición visual, pero a cambio crea otro problema. La página se detiene. El contenido llega más tarde de lo que debería. El Core Web Vitals empieza a cargar con el coste de la prueba, y eso rara vez es lo que pretendían los equipos cuando se proponen comparar una nueva imagen de héroe o el color de un botón.

Los bloqueadores de anuncios crean una forma de daño menos visible pero posiblemente peor. Si se elimina el script de prueba antes de que se ejecute, la visita puede desaparecer por completo del experimento o caer en los informes de forma distorsionada. Lo que hace que esto sea frustrante es lo normal que puede seguir pareciendo el panel de control después. El experimento parece haber recogido datos. Los porcentajes siguen ahí. Las barras de confianza siguen moviéndose. Mientras tanto, una parte del tráfico nunca experimentó la prueba tal y como fue diseñada.

Y luego está la cuestión del alcance, que tiende a subestimarse hasta que un equipo quiere probar algo que realmente afecta al negocio. Las pruebas A/B del lado del cliente son buenas para cambiar lo que aparece en el navegador después de que la página empiece a cargarse. Es mucho menos natural que los experimentos relacionados con la lógica de precios, los modelos de clasificación, los sistemas de recomendación o el comportamiento de pago se decidan antes de montar la página. Ésas son preocupaciones del lado del servidor, y las herramientas del navegador llegan demasiado tarde para apropiárselas adecuadamente.

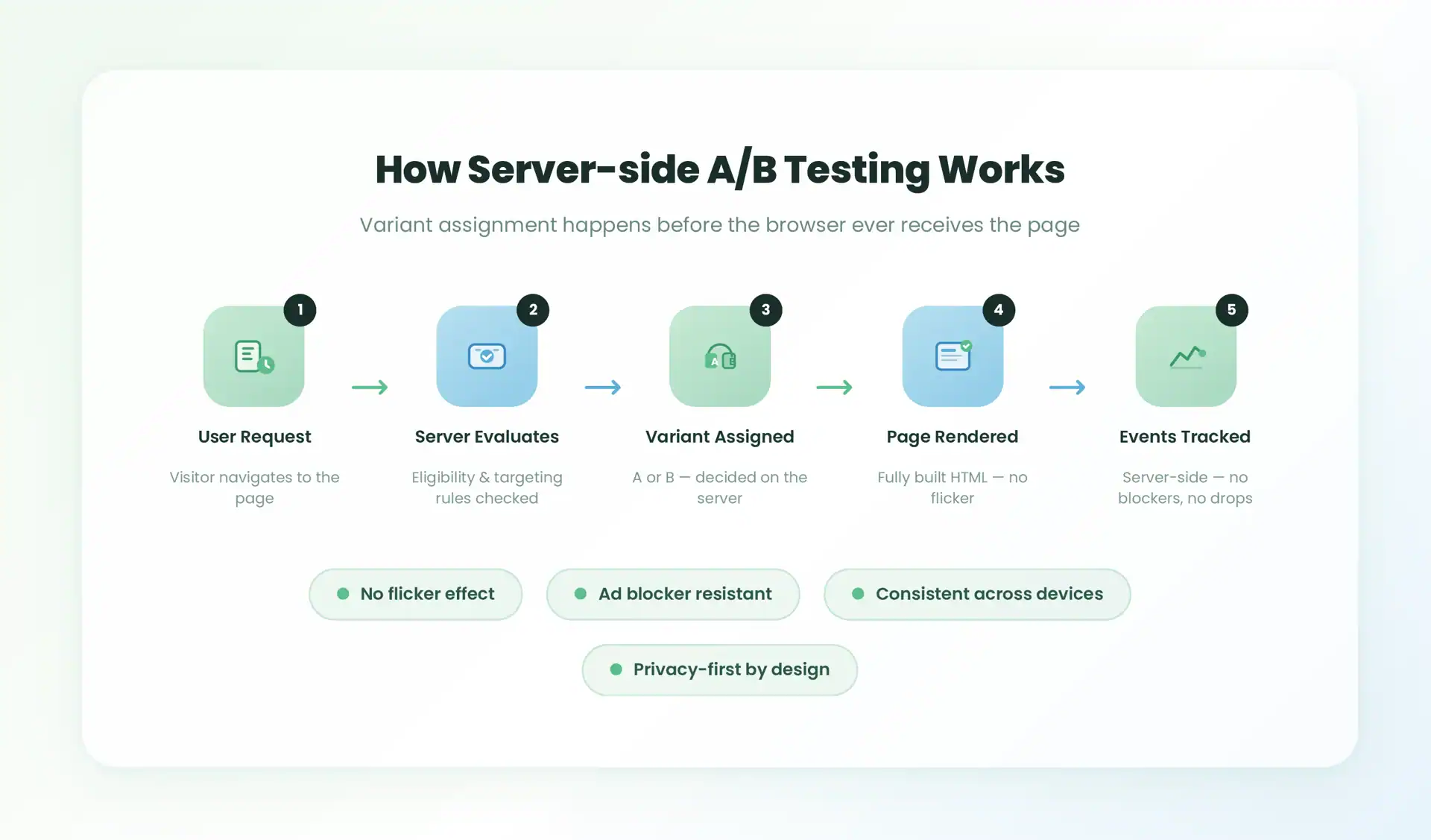

Cómo funcionan las pruebas A/B del lado del servidor

Las pruebas A/B del lado del servidor siguen un flujo sencillo:

- Una solicitud de usuario llega al servidor

- El servidor evalúa la elegibilidad y asigna una variante

- La respuesta se genera en función de esa variante

- El usuario recibe una versión totalmente renderizada sin modificaciones del lado del cliente

- Se realiza un seguimiento de los eventos y los resultados (idealmente en el servidor)

Como la decisión tiene lugar antes de que se cargue la página, el experimento no depende de los scripts del navegador, del almacenamiento o del tiempo de ejecución.

Cómo cambian las pruebas A/B del lado del servidor

Las pruebas A/B del lado del servidor acercan la decisión a la propia aplicación. Llega la solicitud, se evalúa la elegibilidad, se asigna una variante y se construye la respuesta para esa versión antes de que el navegador vea nada. Cuando llega la página, el experimento ya ha ocurrido.

Eso cambia más de lo que la gente espera a primera vista.

El problema del parpadeo desaparece en gran medida porque ya no hay intercambio visual tras la carga. La versión elegida ya está en el HTML. Los bloqueadores de anuncios tienen mucha menos influencia sobre el experimento en sí, porque no hay ningún script de prueba del lado del cliente que tenga que sobrevivir al viaje. Y la asignación puede registrarse en un sistema que el equipo controla realmente, en lugar de en un evento más del navegador que puede dispararse o no en condiciones reales.

También hay un cambio estratégico más amplio que conlleva este modelo. Una vez que la lógica del experimento vive en el servidor, la prueba ya no se limita a cambios superficiales. La clasificación de productos, las reglas de elegibilidad, las decisiones sobre precios, los flujos de incorporación, la lógica de recomendación e incluso partes de la experiencia de pago pueden formar parte de la capa de experimentación. Se trata de una categoría de trabajo muy diferente a cambiar el color de un CTA.

La historia del rendimiento también mejora, aunque aquí conviene ser precisos. Las pruebas del lado del servidor no son automáticamente rápidas en todas las implementaciones. Una mala arquitectura siempre puede ralentizar cualquier cosa. Pero evita gran parte de la sobrecarga del navegador que las herramientas del lado del cliente añaden por defecto. No hay ningún fragmento que oculte páginas, ninguna reescritura del DOM en el último segundo, ninguna dependencia adicional que tenga que cargarse antes de que el experimento parezca estable. En la práctica, eso suele mejorar la experiencia.

Pruebas A/B del lado del cliente frente al lado del servidor

| Client-side | Server-side | |

| Propiedad y aplicación | Da a los vendedores más autonomía a corto plazo. Fácil de lanzar con editores visuales. | Suele requerir la propiedad de la ingeniería por adelantado. Más control, pero mayor coste de instalación. |

| Rendimiento y Vitalidad Web Básica | Puede introducir parpadeos, retrasos al ocultar la página y JavaScript adicional. | Evita la mayor parte de la sobrecarga del navegador. Las variaciones se muestran antes de que la página llegue al usuario. |

| Precisión de los datos | Los resultados pueden estar sesgados por scripts bloqueados, retrasos en la ejecución o cambios visuales tras la carga de la página. El experimento puede parecer completo en el panel de control, mientras que se pierde por completo una parte del tráfico. | La asignación de los experimentos se realiza en el servidor, por lo que los bloqueadores de anuncios, los retrasos de los scripts y los problemas de sincronización del DOM no afectan a la variante que recibe un visitante ni a si se registra el resultado. |

| Flexibilidad | Más potente para cambios superficiales en la página, como el texto, el diseño y las imágenes. | Puede evaluar una lógica más profunda: normas de elegibilidad, precios, clasificación, recomendaciones. |

Por qué se trata realmente de una decisión de arquitectura de medición

La mayoría de los equipos ven primero las pruebas A/B como una actividad de CRO. Es comprensible, pero una vez que los experimentos se trasladan al servidor, lo que está en juego cambia. Lo que parecía una táctica de optimización de la página empieza a convertirse en una decisión de arquitectura de medición.

El cambio se produce de varias formas claras:

La primera es el alcance. Las pruebas del lado del cliente suelen limitarse a la interfaz de usuario. Las pruebas del lado del servidor pueden llegar a la lógica de los precios, la clasificación de las búsquedas, los sistemas de recomendación, los flujos de incorporación y otras capas de decisión que dan forma a la experiencia completa.

El segundo es el contexto. En lugar de pruebas de páginas aisladas, los equipos pueden pensar en términos de recorridos más amplios que conecten con la atribución, el retargeting y la calidad de la señal en todos los canales. Ese problema de medición más amplio se explica con más detalle aquí: https://taggrs.io/retargeting-strategies-signal-loss/

El tercer turno es el operativo. Los experimentos basados en navegadores se ejecutan en un entorno lleno de bloqueadores, scripts retrasados e identificadores incoherentes. Los experimentos del lado del servidor trasladan más de esa lógica a sistemas que el equipo controla realmente.

Y el cuarto cambio es normativo. Cuando los experimentos se llevan a cabo en distintas regiones, dispositivos y entornos de privacidad más estrictos, las configuraciones del lado del servidor suelen ser más fáciles de alinear con la gestión de datos orientada al GDPR, ya que la recopilación y el procesamiento pueden diseñarse de forma más deliberada.

Por eso también deberían preocuparse las agencias. Rara vez se juzga a las agencias sólo por si una variante levanta clics en una página. Se les juzga por si el resultado es fiable para todos los clientes, canales, sistemas de información y decisiones presupuestarias. Por eso las pruebas A/B del lado del servidor se entienden mejor como infraestructura, no sólo como optimización.

Donde el lado del cliente todavía tiene sentido

Las pruebas A/B del lado del cliente no están obsoletas.

Sigue siendo útil para:

- Experimentos rápidos a nivel de página

- Campañas temporales

- Cambios en el diseño ligero

Las pruebas del lado del cliente son convenientes cuando es aceptable un pequeño nivel de incertidumbre. Las pruebas del lado del servidor se hacen necesarias cuando la incertidumbre se vuelve costosa.

Ese cambio puede producirse por varias razones. Quizá el experimento toque la lógica de los ingresos. Tal vez la organización opera a una escala suficiente como para que un pequeño error de medición tenga un impacto financiero real. Tal vez la misma prueba deba ser coherente en todos los dispositivos o estados de inicio de sesión. O puede que la empresa simplemente esté cansada de fingir que la entrega y la medición del navegador son lo bastante estables para tomar decisiones que tengan un peso real.

5 escenarios ideales para las pruebas A/B del lado del servidor

Las pruebas A/B del lado del servidor tienen más sentido cuando el experimento va más allá de los cambios cosméticos de la página y empieza a tocar la lógica en la que es más difícil confiar en el navegador.

- Lógica compleja de personalización y elegibilidad que debe evaluarse antes de mostrar la página

- Entornos muy transitados o de alto riesgo en los que incluso pequeños errores de medición pueden salir caros

- Validación de cambios en sitios web, aplicaciones o productos en los que el rendimiento, la estabilidad y la precisión de los datos son importantes al mismo tiempo.

- Ejecutar experimentos sin añadir scripts de ocultación de páginas, parpadeos o sobrecargas adicionales del lado del cliente que puedan dañar la coherencia de la UX.

- Teams that have outgrown GA4 for experiment analysis and need a proper experimentation toolset such as Optimizely Feature Experimentation, Amplitude Experiment, Statsig, VWO, or LaunchDarkly.

Conceptos básicos de aplicación

Una configuración del lado del servidor suele comenzar con una plataforma que admita SDK del lado del servidor o evaluación de funciones en el backend. Optimizely Feature Experimentation, Amplitude Experiment, Statsig, VWO y LaunchDarkly aparecen en esta conversación por una razón. Cada una ofrece a los equipos una combinación ligeramente diferente de gestión de experimentos, orientación y herramientas estadísticas, y la elección correcta depende en gran medida de la pila que la rodea.

A partir de ahí, la evaluación de variantes necesita un hogar dentro de la aplicación. En algunas pilas eso vive en los servicios backend. En otras, se encuentra en el middleware, la lógica de borde o la capa de renderizado. Lo que más importa es el tiempo. La asignación tiene que producirse antes de que se ensamble la respuesta, no después de que la página empiece a cargarse en el navegador.

Las métricas merecen tanta atención como la lógica de asignación. Esta es la parte que los equipos suelen subestimar. Un experimento sólo es tan útil como el flujo de eventos que lo mide, y ese flujo de eventos aún puede degradarse si depende de scripts de navegador que se enfrentan a bloqueadores, restricciones de almacenamiento o solicitudes caídas. Hacer bien el tratamiento es sólo la mitad del trabajo.

También es la razón por la que GA4 no suele ser la mejor herramienta para el análisis de experimentos serios. GA4 es excelente para muchos casos de uso analítico, pero la experimentación controlada ejerce una presión diferente sobre los datos. El muestreo, los límites de sesión y la lógica de atribución pueden dificultar la interpretación más de lo necesario. Las plataformas dedicadas a la experimentación están diseñadas para este tipo de análisis de una forma que no lo están las herramientas analíticas generales.

Dónde encaja TAGGRS

TAGGRS es importante cuando un equipo quiere que la experimentación del lado del servidor conduzca a informes en los que realmente puedan confiar, no sólo a una entrega de variantes más limpia.

Las pruebas A/B del lado del servidor resuelven una parte del problema. Decide la variante antes de que la página llegue al navegador, lo que elimina gran parte del ruido habitual del lado del cliente. Esto es importante, pero es sólo la mitad de la cadena de medición. La otra mitad es lo que ocurre después de que el usuario vea la página: qué eventos se capturan, cómo se enriquecen, adónde se reenvían y si siguen llegando intactos cuando los navegadores, los bloqueadores o los scripts frágiles se interponen.

Esa es la brecha que TAGGRS ayuda a cerrar. TAGGRS ejecuta la infraestructura de Google Tag Manager en el servidor, de modo que los eventos del experimento, los eventos de conversión y las señales de atribución pueden procesarse en el servidor en lugar de depender tanto del navegador. En términos prácticos, eso significa que no hay solicitudes bloqueadas, ni señales perdidas, y más posibilidades de que plataformas como Google Ads, Meta y GA4 reciban datos que sigan coincidiendo con lo que realmente ocurrió en el experimento.

Sin esa capa, una empresa puede actualizar la configuración del experimento y dejar la configuración del informe estancada en la misma posición de debilidad que antes. La asignación de variantes se hace más fiable, pero los datos de conversión pueden seguir estando incompletos. Los bloqueadores de anuncios pueden seguir interfiriendo. Las restricciones del navegador todavía pueden eliminar identificadores o impedir que se disparen las solicitudes. La atribución aún puede alejarse de la realidad. Así que el experimento parece más limpio sobre el papel, mientras que la medición que hay detrás sigue siendo inconsistente.

Con TAGGRS en su lugar, la configuración se vuelve más coherente. El experimento se decide en el servidor, y la cadena de medición también se acerca más al servidor. Esto proporciona a los equipos un control más estricto sobre cómo se recogen, transforman y envían los datos. También facilita la estandarización de la gestión de eventos entre experimentos, plataformas publicitarias y herramientas de análisis, en lugar de dejar que cada sesión del navegador determine lo que sobrevive.

Eso importa más cuando los experimentos influyen en decisiones reales. Si una agencia está utilizando los resultados de las pruebas para defender una recomendación presupuestaria, si un equipo de producto está cambiando la lógica de fijación de precios, o si la dirección está comparando variantes que afectan a los ingresos, entonces la medición parcial es una debilidad grave. En esos casos, TAGGRS no es sólo un complemento de seguimiento. Forma parte de la infraestructura que ayuda a que los resultados del experimento sean utilizables en primer lugar.

Ninguna configuración analítica llega a ser perfecta, y el TAGGRS no elimina mágicamente todas las fuentes de ruido. Pero hace que el sistema sea mucho más difícil de romper. De eso se trata. Las pruebas en el servidor te proporcionan un experimento más limpio. TAGGRS ayuda a garantizar que los datos que salen de ese experimento también sean más limpios.

Conclusión

Las pruebas A/B del lado del servidor adquieren más valor a medida que la experimentación va más allá de los ajustes de la interfaz de usuario y empieza a influir en la lógica del producto, la atribución y las decisiones sobre ingresos. Las pruebas del lado del cliente siguen teniendo un papel. Pero para los equipos que se preocupan por la confianza en las decisiones, las pruebas del lado del servidor proporcionan una base más sólida.

Cuando se combina con TAGGRS, crea un sistema en el que tanto la experimentación como la medición son más fiables.

Ésa es la verdadera ventaja: no sólo mejores pruebas, sino mejores decisiones.

PREGUNTAS FRECUENTES: Pruebas A/B en el servidor

¿Qué es la prueba A/B del lado del servidor?

Las pruebas A/B del lado del servidor asignan las variaciones del experimento antes de que se cargue la página, lo que garantiza una entrega coherente y datos más fiables.

¿Las pruebas A/B del lado del servidor son mejores que las del lado del cliente?

Depende. El lado del servidor es mejor para la precisión, el rendimiento y la lógica compleja. El lado del cliente es más rápido para pruebas sencillas.

¿Las pruebas A/B del lado del servidor mejoran la precisión de los datos?

Sí. Reduce el impacto de los bloqueadores de anuncios, los retrasos de los scripts y los eventos de seguimiento perdidos.