Serverseitige A/B-Tests: bessere Experimente, bessere Messungen

Serverseitige A/B-Tests sind eine Methode, bei der Experimentvarianten auf dem Server zugewiesen und gerendert werden, bevor die Seite im Browser geladen wird. Diese Art des Testens verbessert die Zuverlässigkeit der Experimente, da sie einige der häufigsten Probleme auf der Client-Seite bereits an der Quelle beseitigt:

- Skripte werden von Werbeblockern entfernt

- verzögerte Ausführung, die das, was der Besucher sieht, verändert

- den Flimmereffekt, bei dem die Originalseite erscheint, bevor die Variante nachzieht.

Diese Probleme verzerren die Testergebnisse. Ein Test, der zu spät lädt oder sich uneinheitlich verhält, mischt bereits Lieferprobleme in das Ergebnis ein, was es für Marketingfachleute und Agenturen schwieriger macht, dem Ergebnis zu vertrauen.

Besonders für Agenturen ist das wichtig. Die Aufgabe besteht selten nur darin, ein Experiment zu starten. Die Aufgabe besteht darin, Experimente durchzuführen, die zuverlässig, datenschutzkonform und aussagekräftig genug sind, um Budgetentscheidungen über Kunden und Kanäle hinweg zu unterstützen. Wenn der Aufbau des Experiments selbst anfällig ist, kann die Berichterstattung überzeugend aussehen, während die Daten darunter unvollständig sind.

Es gibt auch einen Leistungsaspekt. Client-seitige Tests verwenden oft zusätzliches JavaScript und Techniken zum Ausblenden von Seiten, die die wahrgenommene Geschwindigkeit und Core Web Vitals beeinträchtigen können. Wenn Sie die Beziehung zwischen serverseitigen Einstellungen, Flimmern und der Seitengeschwindigkeit genauer verstehen möchten, lesen Sie Wie wirkt sich serverseitiges Tracking auf die Seitengeschwindigkeit aus?

Bei serverseitigen A/B-Tests geht es nicht nur um sauberere Experimente: Sie sind Teil einer breiteren Verlagerung hin zu datenschutzfreundlichen Messungen und besserer Datenqualität. Ein gutes Verständnis dieses Themas hilft Agenturen dabei, Experimentierprogramme zu entwickeln, die auch einer genauen Prüfung standhalten.

Client-seitige Tests funktionieren so lange, bis die Umgebung anfängt, sich zu wehren

Client-seitige A/B-Tests sind flexibel, vertraut und relativ einfach zu starten. Tools wie VWO und Optimizely bieten den Teams visuelle Editoren, eine schnelle Einrichtung und die Möglichkeit, Änderungen auf Seitenebene ohne große technische Unterstützung zu testen. Für Landing Pages, Messaging-Tests und einfache Layout-Experimente ist das immer noch wichtig.

Das Problem beginnt, wenn diese Experimente so behandelt werden, als würden sie in einem kontrollierten Labor stattfinden. Die Realität ist: das tun sie nicht. Sie finden im Browser statt, einem der chaotischsten Orte im Stack, auf den man sich verlassen kann.

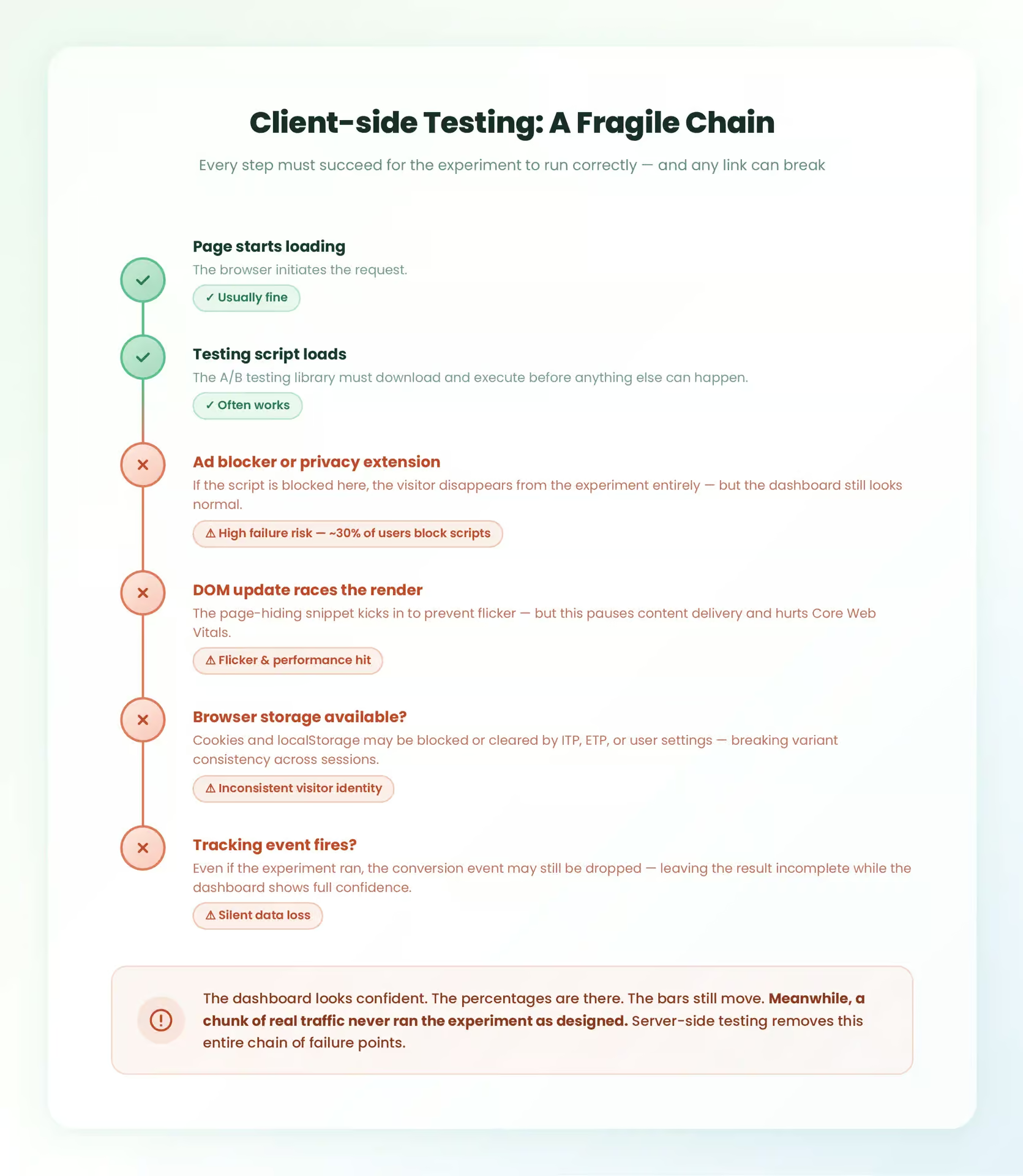

Ein clientseitiger A/B-Test muss eine ziemlich lange Kette von Ereignissen überstehen. Die Seite wird geladen, das Testskript wird geladen, der Browser lässt die Ausführung zu, etwaige Blocker oder Datenschutzerweiterungen lassen sie in Ruhe, der benötigte Speicherplatz bleibt verfügbar, das DOM wird korrekt aktualisiert und der Tracking-Aufruf wird auch danach noch ausgelöst. Wenn das alles funktioniert, kann das Experiment sauber aussehen. Wenn auch nur ein einziger Schritt misslingt, sieht die Berichterstattung immer noch sicherer aus, als sie sein sollte.

Flicker ist das sichtbarste Beispiel. Ein Besucher landet auf der Seite, sieht für den Bruchteil einer Sekunde die Originalversion und sieht dann, wie die Variante einrastet. Das mag unbedeutend klingen, aber es verändert das Erlebnis in genau dem Moment, den der Test messen soll. Einige Besucher klicken schneller als erwartet. Einige zögern. Einige verlassen die Seite, weil sie sich kurzzeitig nicht sicher fühlen. An diesem Punkt misst das Experiment nicht mehr nur die Designänderung. Es misst auch die Nebeneffekte der Bereitstellungsmethode.

Die Leistung ist mit dem gleichen Problem verbunden. Viele Testtools versuchen, das Flimmern zu reduzieren, indem sie Teile der Seite ausblenden, bis die Variante fertig ist. Diese Abhilfe kann den visuellen Übergang schützen, schafft aber im Gegenzug ein anderes Problem. Die Seite pausiert. Der Inhalt wird später angezeigt als er sollte. Core Web Vitals beginnt, die Kosten für den Test zu tragen, und das ist selten das, was die Teams beabsichtigen, wenn sie ein neues Heldenbild oder eine neue Schaltflächenfarbe vergleichen wollen.

Werbeblocker verursachen eine weniger sichtbare, aber wohl schlimmere Form des Schadens. Wenn das Testskript entfernt wird, bevor es ausgeführt wird, kann der Besuch ganz aus dem Experiment verschwinden oder in einer verzerrten Form in die Berichterstattung einfließen. Das Frustrierende daran ist, wie normal das Dashboard danach aussehen kann. Das Experiment scheint Daten gesammelt zu haben. Die Prozentsätze sind noch da. Die Vertrauensbalken bewegen sich noch. In der Zwischenzeit hat ein Teil des Datenverkehrs den Test nie wie geplant durchlaufen.

Und dann ist da noch die Frage des Umfangs, die oft unterschätzt wird, bis ein Team etwas testen will, das sich tatsächlich auf das Geschäft auswirkt. Client-seitige A/B-Tests sind gut geeignet, um zu ändern, was im Browser erscheint, nachdem die Seite geladen wurde. Es ist weit weniger natürlich, dass Experimente, die mit der Preislogik, Ranking-Modellen, Empfehlungssystemen oder dem Kaufverhalten verbunden sind, entschieden werden, bevor die Seite zusammengestellt wird. Das sind serverseitige Angelegenheiten, und Browser-Tools kommen zu spät, um sie richtig zu beherrschen.

So funktionieren serverseitige A/B-Tests

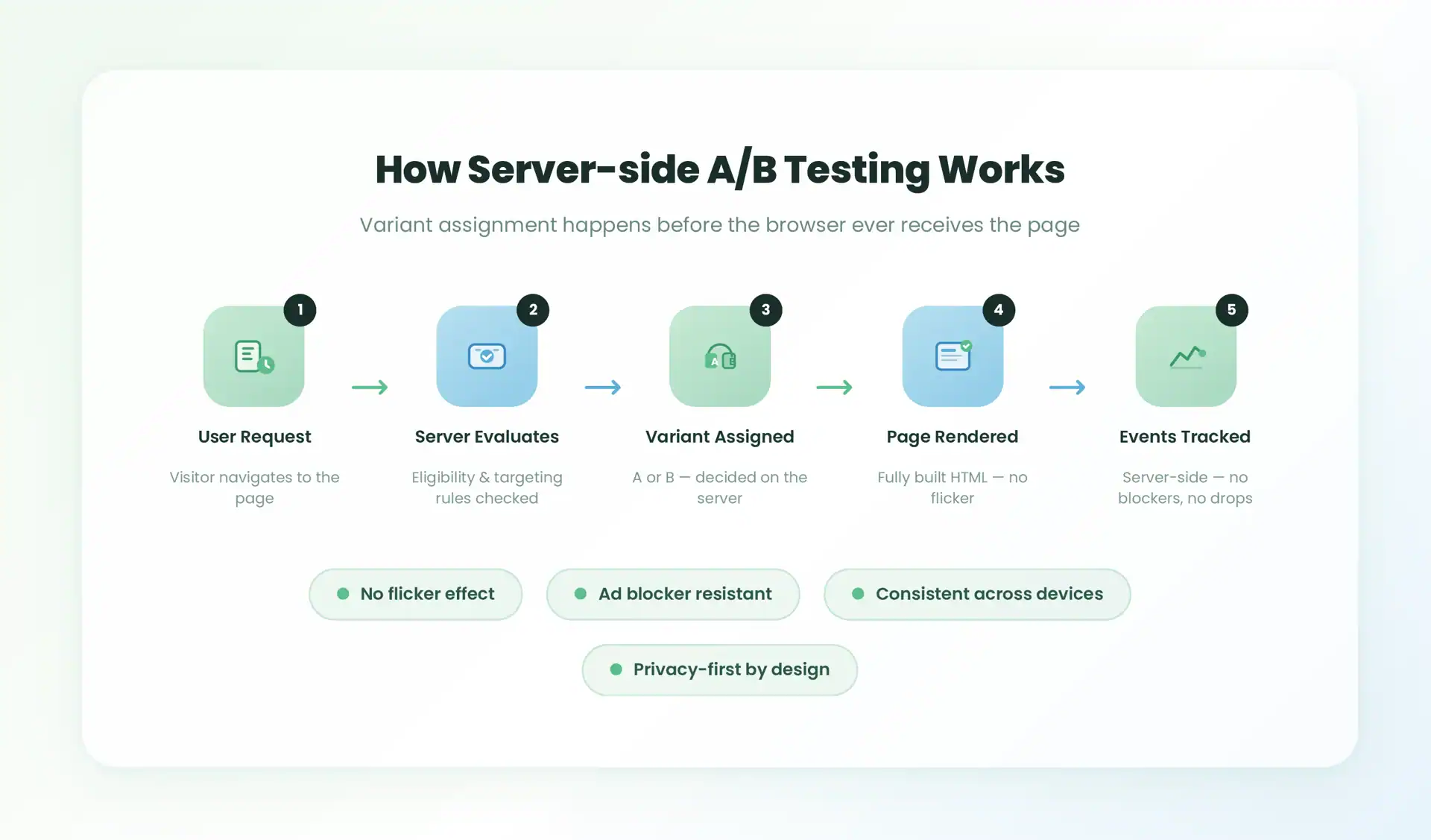

Serverseitige A/B-Tests folgen einem einfachen Ablauf:

- Eine Benutzeranfrage erreicht den Server

- Der Server prüft die Berechtigung und weist eine Variante zu

- Die Antwort wird auf der Grundlage dieser Variante generiert

- Der Benutzer erhält eine vollständig gerenderte Version ohne client-seitige Änderungen

- Ereignisse und Ergebnisse werden nachverfolgt (idealerweise serverseitig)

Da die Entscheidung getroffen wird, bevor die Seite geladen wird, ist das Experiment nicht von Browser-Skripten, Speicherplatz oder Ausführungszeiten abhängig.

Wie serverseitige A/B-Tests das Bild verändern

Serverseitige A/B-Tests verlagern die Entscheidung näher an die Anwendung selbst. Die Anfrage kommt herein, die Eignung wird bewertet, eine Variante wird zugewiesen und die Antwort wird für diese Version erstellt, bevor der Browser etwas sieht. Zu dem Zeitpunkt, an dem die Seite ankommt, hat das Experiment bereits stattgefunden.

Das ändert mehr, als man zunächst erwartet.

Das Flackerproblem verschwindet weitgehend, da es nach dem Laden keinen visuellen Wechsel mehr gibt. Die gewählte Version ist bereits in der HTML-Datei enthalten. Werbeblocker haben viel weniger Einfluss auf das Experiment selbst, da es kein clientseitiges Testskript gibt, das die Reise überleben muss. Und die Zuordnung kann in einem System protokolliert werden, das das Team tatsächlich kontrolliert, anstatt ein weiteres Browser-Ereignis zu sein, das unter realen Bedingungen ausgelöst werden kann oder auch nicht.

Mit diesem Modell ist auch ein umfassenderer strategischer Wandel verbunden. Sobald sich die Experimentierlogik auf dem Server befindet, ist der Test nicht mehr auf Oberflächenänderungen beschränkt. Produktranking, Berechtigungsregeln, Preisentscheidungen, Onboarding-Ströme, Empfehlungslogik und sogar Teile der Kaufabwicklung können Teil der Experimentierschicht werden. Das ist eine ganz andere Kategorie von Arbeit als die Änderung einer CTA-Farbe.

Auch die Leistung verbessert sich, obwohl es sich lohnt, hier genau zu sein. Serverseitige Tests sind nicht bei jeder Implementierung automatisch schnell. Eine schlechte Architektur kann immer etwas verlangsamen. Aber es vermeidet einen Großteil des browserseitigen Overheads, den clientseitige Tools standardmäßig hinzufügen. Kein Seitenausblendungs-Snippet, kein DOM-Rewrite in letzter Sekunde, keine zusätzliche Abhängigkeit, die erst geladen werden muss, bevor sich das Experiment stabil anfühlt. In der Praxis führt dies in der Regel zu einem besseren Erlebnis.

Client-seitige vs. Server-seitige A/B-Tests

| Client-side | Server-side | |

| Eigentümerschaft & Implementierung | Bietet Vermarktern kurzfristig mehr Autonomie. Einfacher Start mit visuellen Editoren. | Erfordert in der Regel eine technische Beteiligung im Vorfeld. Mehr Kontrolle, aber höhere Einrichtungskosten. |

| Leistung & Core Web Vitals | Kann Flimmern, Verzögerungen beim Ausblenden der Seite und zusätzliches JavaScript verursachen. | Vermeidet den meisten Browser-Overhead. Variationen werden gerendert, bevor die Seite den Benutzer erreicht. |

| Genauigkeit der Daten | Die Ergebnisse können durch blockierte Skripte, verzögerte Ausführung oder visuelle Änderungen nach dem Laden der Seite verzerrt werden. Das Experiment kann auf dem Dashboard vollständig aussehen, während ein Teil des Datenverkehrs völlig fehlt. | Die Zuweisung der Experimente erfolgt auf dem Server, so dass Werbeblocker, Skriptverzögerungen und DOM-Timing-Probleme keinen Einfluss darauf haben, welche Variante ein Besucher erhält oder ob das Ergebnis aufgezeichnet wird. |

| Flexibilität | Am besten geeignet für oberflächliche Seitenänderungen wie Texte, Layout und Bilder. | Kann eine tiefere Logik auswerten: Berechtigungsregeln, Preisgestaltung, Ranking, Empfehlungen. |

Warum dies wirklich eine Entscheidung der Messarchitektur ist

Die meisten Teams sehen A/B-Tests zunächst als eine CRO-Aktivität. Das ist verständlich, aber sobald die Experimente auf den Server verlagert werden, ändert sich die Ausgangslage. Was zunächst wie eine Taktik zur Seitenoptimierung aussah, wird dann zu einer Entscheidung über die Messarchitektur.

Der Wandel vollzieht sich auf einige klare Arten:

Der erste ist der Umfang. Client-seitige Tests bleiben in der Regel auf die Benutzeroberfläche beschränkt. Serverseitige Tests können sich auf die Preislogik, das Suchranking, Empfehlungssysteme, den Einführungsprozess und andere Entscheidungsebenen erstrecken, die das gesamte Erlebnis ausmachen.

Der zweite Punkt ist der Kontext. Anstelle von isolierten Seitentests können Teams in Form von umfassenderen Journeys denken, die mit Attribution, Retargeting und Signalqualität über alle Kanäle hinweg verbunden sind. Dieses umfassendere Messproblem wird hier ausführlicher erläutert: https://taggrs.io/retargeting-strategies-signal-loss/

Die dritte Schicht ist operativ. Browser-basierte Experimente laufen in einer Umgebung voller Blocker, verzögerter Skripte und inkonsistenter Identifikatoren. Serverseitige Experimente verlagern mehr von dieser Logik in Systeme, die das Team tatsächlich kontrolliert.

Und die vierte Veränderung ist regulatorischer Natur. Wenn Experimente in verschiedenen Regionen, auf verschiedenen Geräten und in strengeren Datenschutzumgebungen durchgeführt werden, sind serverseitige Konfigurationen oft leichter mit der GDPR-konformen Datenverarbeitung in Einklang zu bringen, da die Erfassung und Verarbeitung bewusster gestaltet werden kann.

Das ist auch der Grund, warum Agenturen sich darum kümmern sollten. Agenturen werden selten nur danach beurteilt, ob eine Variante die Klicks auf einer Seite erhöht. Sie werden danach beurteilt, ob das Ergebnis über Kunden, Kanäle, Berichtssysteme und Budgetentscheidungen hinweg verlässlich ist. Aus diesem Grund sind serverseitige A/B-Tests besser als Infrastruktur zu verstehen , nicht nur als Optimierung.

Wo Client-Side noch Sinn macht

Client-seitige A/B-Tests sind nicht überflüssig.

Es bleibt nützlich für:

- Schnelle Experimente auf Seitenebene

- Zeitlich begrenzte Kampagnen

- Leichtgewichtige Designänderungen

Client-seitige Tests sind praktisch, wenn ein geringes Maß an Unsicherheit akzeptabel ist. Serverseitige Tests werden notwendig, wenn die Unsicherheit teuer wird.

Diese Verschiebung kann aus verschiedenen Gründen geschehen. Vielleicht berührt das Experiment die Umsatzlogik. Vielleicht ist das Unternehmen so groß, dass ein kleiner Messfehler eine echte finanzielle Auswirkung hat. Vielleicht muss ein und derselbe Test über alle Geräte oder eingeloggten Zustände hinweg konsistent bleiben. Oder vielleicht ist das Unternehmen einfach müde, so zu tun, als seien die Browserauslieferung und die Browsermessung stabil genug für Entscheidungen, die wirklich Gewicht haben.

5 ideale Szenarien für serverseitige A/B-Tests

Serverseitige A/B-Tests sind dann am sinnvollsten, wenn das Experiment über kosmetische Änderungen an der Seite hinausgeht und die Logik berührt, die im Browser schwieriger zu kontrollieren ist.

- Komplexe Personalisierungs- und Berechtigungslogik, die ausgewertet werden muss, bevor die Seite gerendert wird

- Hochfrequentierte oder risikoreiche Umgebungen, in denen selbst kleine Messfehler teuer werden können

- Validierung von Website-, App- oder Produktänderungen, bei denen es gleichzeitig auf Leistung, Stabilität und Datengenauigkeit ankommt

- Durchführung von Experimenten ohne Hinzufügen von Skripten zum Ausblenden von Seiten, Flackern oder zusätzlichen clientseitigen Overhead, der die Konsistenz der Benutzeroberfläche beeinträchtigen kann

- Teams, die aus GA4 für die Analyse von Experimenten herausgewachsen sind und ein richtiges Experimentier-Toolset wie Optimizely Feature Experimentation, Amplitude Experiment, Statsig, VWO oder LaunchDarkly benötigen.

Grundlagen der Implementierung

Eine serverseitige Einrichtung beginnt in der Regel mit einer Plattform, die serverseitige SDKs oder Feature-Evaluierung im Backend unterstützt. Optimizely Feature Experimentation, Amplitude Experiment, Statsig, VWO und LaunchDarkly werden in diesem Zusammenhang nicht ohne Grund erwähnt. Jede dieser Plattformen bietet Teams eine etwas andere Mischung aus Experimentmanagement, Targeting und statistischen Werkzeugen, und die richtige Wahl hängt stark von dem sie umgebenden Stack ab.

Von dort aus braucht die Variantenbewertung ein Zuhause innerhalb der Anwendung. In einigen Stacks ist das in Backend-Diensten der Fall. In anderen ist sie in der Middleware, der Edge-Logik oder der Rendering-Schicht angesiedelt. Das Wichtigste ist das Timing. Die Zuweisung muss erfolgen, bevor die Antwort zusammengestellt wird, und nicht, nachdem die Seite im Browser zu laden beginnt.

Metriken verdienen ebenso viel Aufmerksamkeit wie die Zuweisungslogik. Das ist der Teil, den Teams oft unterschätzen. Ein Experiment ist nur so nützlich wie der Ereignisstrom, der es misst, und dieser Ereignisstrom kann sich noch verschlechtern, wenn er von Browserskripten abhängt, die mit Blockern, Speicherbeschränkungen oder abgebrochenen Anfragen zu kämpfen haben. Die richtige Behandlung ist nur die Hälfte der Aufgabe.

Das ist auch der Grund, warum GA4 in der Regel nicht das beste Tool für die Analyse ernsthafter Experimente ist. GA4 ist für viele analytische Anwendungsfälle hervorragend geeignet, aber kontrollierte Experimente setzen die Daten einem anderen Druck aus. Stichproben, Sitzungsgrenzen und Zuordnungslogik können die Interpretation schwieriger machen, als sie sein müsste. Dedizierte Experimentierplattformen sind für diese Art der Analyse in einer Weise konzipiert, wie es allgemeine Analysetools nicht sind.

Wo TAGGRS passt

TAGGRS ist wichtig, wenn ein Team möchte, dass serverseitige Experimente zu Berichten führen, denen es tatsächlich vertrauen kann, und nicht nur zu einer saubereren Variantenlieferung.

Serverseitige A/B-Tests lösen einen Teil des Problems. Es entscheidet über die Variante, bevor die Seite den Browser erreicht, wodurch ein Großteil des üblichen clientseitigen Rauschens beseitigt wird. Das ist wichtig, aber es ist nur die Hälfte der Messkette. Die andere Hälfte ist das, was passiert, nachdem der Benutzer die Seite gesehen hat: welche Ereignisse erfasst werden, wie sie angereichert werden, wohin sie weitergeleitet werden und ob sie noch intakt ankommen, wenn Browser, Blocker oder anfällige Skripte in den Weg kommen.

Genau diese Lücke kann TAGGRS schließen. TAGGRS führt die serverseitige Google Tag Manager-Infrastruktur aus, so dass Experiment-Ereignisse, Conversion-Ereignisse und Attributionssignale auf dem Server verarbeitet werden können, anstatt so stark vom Browser abhängig zu sein. In der Praxis bedeutet dies, dass keine Anfragen blockiert werden, keine Signale verloren gehen und die Chance größer ist, dass Plattformen wie Google Ads, Meta und GA4 Daten erhalten, die mit dem übereinstimmen, was im Experiment tatsächlich passiert ist.

Ohne diese Schicht kann ein Unternehmen den Versuchsaufbau aktualisieren, während der Berichtsaufbau in der gleichen schwachen Position wie zuvor stecken bleibt. Die Variantenzuweisung wird zuverlässiger, aber die Konversionsdaten können immer noch unvollständig sein. Werbeblocker können immer noch stören. Browser-Beschränkungen können immer noch Identifikatoren entfernen oder verhindern, dass Anfragen ausgelöst werden. Die Attribution kann immer noch von der Realität abweichen. Das Experiment sieht also auf dem Papier sauberer aus, während die Messung dahinter inkonsistent bleibt.

Mit TAGGRS wird der Aufbau kohärenter. Das Experiment wird serverseitig entschieden, und auch die Messpipeline wird näher an den Server verlegt. Dadurch haben die Teams eine bessere Kontrolle darüber, wie die Daten gesammelt, umgewandelt und weitergeleitet werden. Es macht es auch einfacher, die Ereignisbehandlung über Experimente, Werbeplattformen und Analysetools hinweg zu standardisieren, anstatt es jeder Browsersitzung zu überlassen, was sie überlebt.

Das ist besonders wichtig, wenn Experimente echte Entscheidungen beeinflussen. Wenn eine Agentur Testergebnisse verwendet, um eine Budgetempfehlung zu verteidigen, wenn ein Produktteam die Preislogik ändert oder wenn die Geschäftsleitung Varianten vergleicht, die sich auf den Umsatz auswirken, dann ist eine unvollständige Messung eine ernsthafte Schwäche. In diesen Fällen ist TAGGRS nicht nur ein Tracking-Add-on. Es ist Teil der Infrastruktur, die dazu beiträgt, dass die Testergebnisse überhaupt verwertbar sind.

Kein Analysesystem ist perfekt, und TAGGRS beseitigt nicht auf magische Weise jede Störquelle. Aber es macht es viel schwieriger, das System zu knacken. Genau das ist der Punkt. Durch serverseitige Tests erhalten Sie ein sauberes Experiment. TAGGRS trägt dazu bei, dass die Daten, die aus diesem Experiment hervorgehen, ebenfalls sauberer sind.

Fazit

Serverseitige A/B-Tests werden immer wertvoller, wenn die Experimente über die Optimierung der Benutzeroberfläche hinausgehen und beginnen, die Produktlogik, die Attribution und die Umsatzentscheidungen zu beeinflussen. Client-seitige Tests spielen immer noch eine Rolle. Aber für Teams, denen die Sicherheit ihrer Entscheidungen wichtig ist, bieten serverseitige Tests eine bessere Grundlage.

In Kombination mit TAGGRS entsteht ein System, in dem sowohl das Experimentieren als auch die Messung zuverlässiger sind.

Das ist der wahre Vorteil: nicht nur bessere Tests, sondern auch bessere Entscheidungen.

FAQ: Server-seitige A/B-Tests

Was sind serverseitige A/B-Tests?

Serverseitige A/B-Tests weisen Experimentvarianten zu, bevor die Seite geladen wird, und sorgen so für eine konsistente Auslieferung und zuverlässigere Daten.

Sind serverseitige A/B-Tests besser als clientseitige?

Das kommt darauf an. Die Serverseite ist besser für Genauigkeit, Leistung und komplexe Logik. Die Client-Seite ist schneller für einfache Tests.

Verbessert das serverseitige A/B-Testing die Datengenauigkeit?

Ja. Es reduziert die Auswirkungen von Werbeblockern, Skriptverzögerungen und fehlenden Tracking-Ereignissen.